En Resumen: lo imprescindible

Los Agentes de Inteligencia Artificial: de “copilotos” a colegas digitales

- Los agentes pasan a la capa “sistema operativo”: Microsoft acelera su visión de un agentic OS en Windows y empuja gestión/seguridad de flotas de agentes en empresa.

- Tooling y estándares se consolidan: crece el foco en protocolos y “control planes” para conectar agentes con herramientas, datos y permisos.

- La investigación se dispara: aparecen nuevas métricas/benchmarks para evaluar agentes (robustez, razonamiento, GUI automation, ciberseguridad, etc.).

- Lo “local-first” acelera (modelos y despliegue): en tendencias aparecen modelos listos para ejecutar o adaptar en local (TTS en tiempo real, VLMs con function calling, LLMs para coding/agentes), lo que reduce barreras para prototipar agentes sin depender 100% de APIs.

- El desarrollo entra en fase de orquestación multi‑agente: VS Code/Copilot empiezan a coordinar agentes (locales y en background) para paralelizar tareas sin bloquear tu editor.

- Deep Research pasa a ser “producto para devs”: Google abre un agente de investigación iterativa vía API (con soporte MCP) y empuja benchmarks específicos (DeepSearchQA).

Noticias Recientes

OpenAI impulsa el discurso “agentic” con novedades y alianzas

OpenAI cofundó la Agentic AI Foundation y dona el documento

AGENTS.md(enfoque de estandarización/prácticas para agentes).En la práctica, esto apunta a profesionalizar el desarrollo de agentes: guías de diseño, convenciones para describir capacidades/limitaciones y, sobre todo, una base común para que equipos distintos puedan interoperar. Es una señal clara de que el ecosistema se está moviendo de prototipos aislados a despliegues repetibles y auditables.

Fuente: [clic aquí]

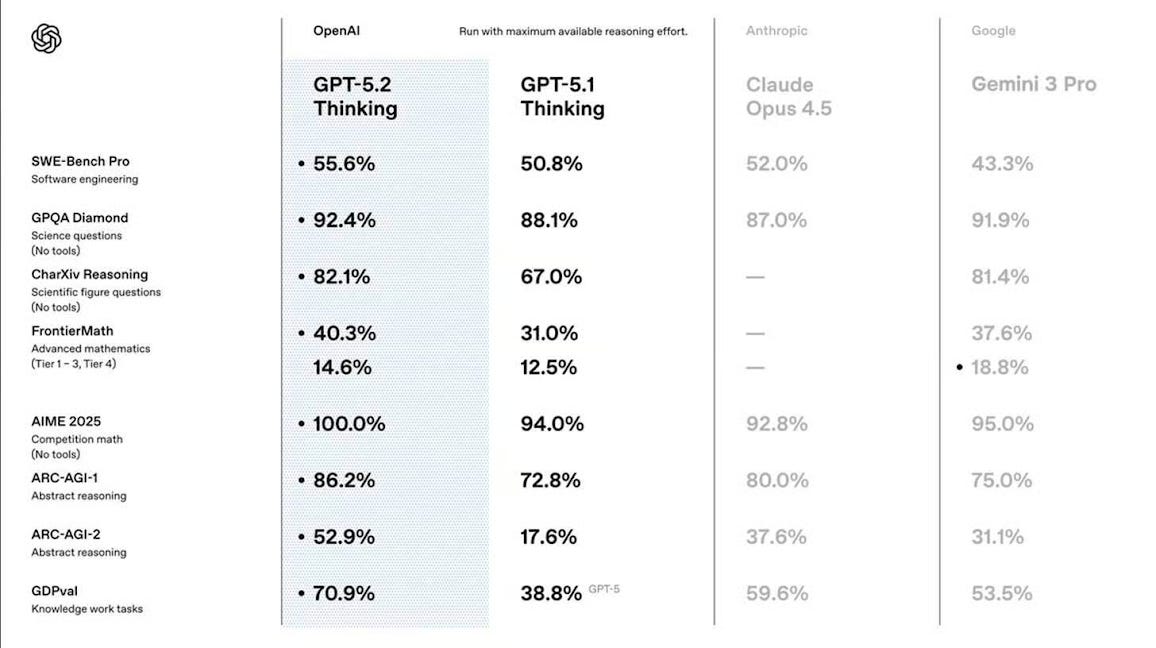

OpenAI lanza GPT‑5.2 (+ actualiza la System Card) y lo posiciona fuerte para ciencia/matemáticas (relevante porque muchas arquitecturas agentic se apoyan en modelos con razonamiento más estable).

Aunque no sea un agente por sí mismo, un salto en razonamiento y estabilidad suele traducirse en menos fallos en cadenas de herramientas (tool use), mejores planes y menos alucinación al resumir resultados de múltiples fuentes. Además, la System Card aporta pistas de riesgos/mitigaciones que conviene incorporar en productos agentic (límites, evaluaciones, guardrails).

Fuentes: [clic aquí] [aquí] [o aquí]

Anthropic: foco en “agentic AI” para producción y ecosistema

Anthropic también comunica la donación del Model Context Protocol (MCP) y la creación de la Agentic AI Foundation (señal de “estándares primero”).

Aquí lo importante es el mensaje: sin una forma estándar de conectar herramientas, datos y permisos, cada agente acaba siendo una integración a medida. MCP y el trabajo fundacional empujan hacia un ecosistema con conectores reutilizables, menor lock‑in y mejores prácticas compartidas para seguridad y control.

Fuente: [clic aquí]

Claude Code se expande al “trabajo real”: integraciones y acuerdos con grandes plataformas (Snowflake, Microsoft, etc.) para llevar agentes a entornos empresariales.

Los agentes están entrando “por donde vive el trabajo” (data/warehouse, suites de productividad, entornos dev). Esto suele acelerar adopción porque reduce fricción: el agente se despliega dentro de herramientas ya aprobadas por IT, con identidad, auditoría y permisos alineados con políticas corporativas.

Fuentes: [clic aquí] [aquí]

Microsoft y el “agentic workplace”

Microsoft convierte Teams en un punto de entrada para agentes (se filtran por reuniones, canales y comunidades).

Teams es una superficie ideal para agentes porque hay conversaciones, calendario, archivos y decisiones. Meter agentes ahí es apostar por automatizar lo repetitivo (resúmenes, seguimiento, creación de tareas) y por capturar contexto de trabajo sin obligar a cambiar de aplicación.

Fuente: [clic aquí]

Agent 365: gestión de agentes “como empleados” (organización, seguridad, control).

Esto es clave para escalado, ya que cuando pasas de 1–2 bots a decenas de agentes por área, necesitas inventario, permisos, límites de actuación, trazabilidad y un modelo operativo (quién responde si algo falla). La metáfora de RRHH no es casual, los agentes se administran como identidades con roles y responsabilidades.

Fuente: [clic aquí]

Windows como “agentic OS”: integración con la barra de tareas como superficie nativa.

Si Windows se vuelve una capa de orquestación, el agente deja de ser una app suelta y pasa a ser un servicio del sistema: descubre intención (lo que haces), sugiere acciones y ejecuta tareas entre aplicaciones. El reto aquí será el equilibrio entre utilidad y control: permisos finos, transparencia (“qué va a hacer”) y opción de undo.

Fuente: [clic aquí]

Google abre su agente Deep Research a desarrolladores

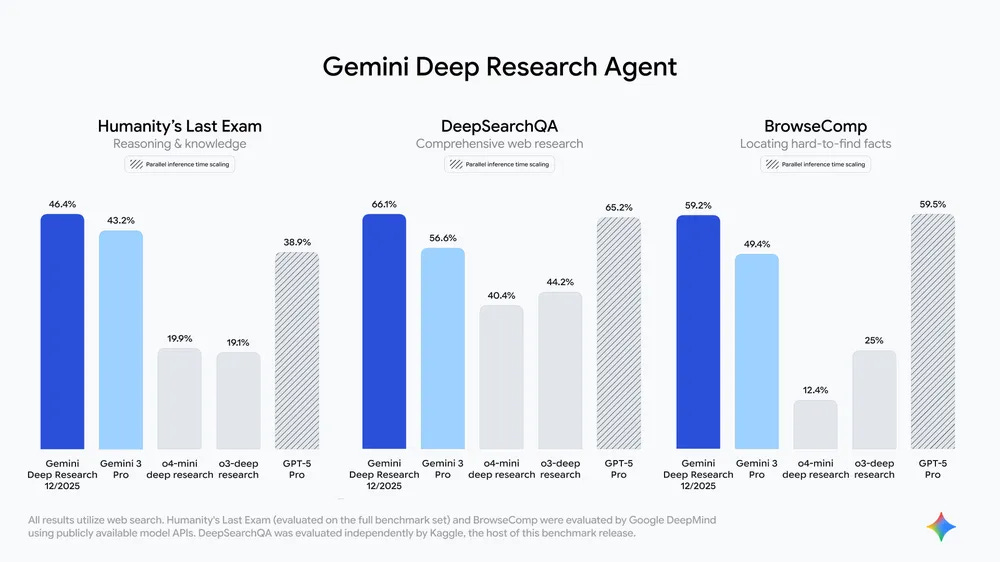

Google lanza una versión significativamente mejorada de Deep Research y la expone a desarrolladores vía una nueva Interactions API (con despliegues al consumidor próximamente en Search, NotebookLM y la app de Gemini).

Lo relevante no es solo el modelo, sino el loop de investigación: el agente planifica búsquedas, lee resultados, detecta huecos y vuelve a consultar hasta cerrar una respuesta. Eso acerca la capa research a un componente reutilizable en productos de terceros (con implicaciones directas para agentes que dependen de web/data retrieval).

Detalles que anunció Google (según el comunicado):

- Corre sobre Gemini 3 Pro y aplica un ciclo iterativo de búsqueda/lectura/refinamiento.

- La Interactions API unifica acceso a modelos y agentes, con soporte nativo para conexiones MCP a herramientas y fuentes de datos externas.

- Publican DeepSearchQA, un benchmark de 900 tareas para evaluar investigación web multi‑paso.

Google afirma resultados SOTA en Humanity’s Last Exam (46.4%) y DeepSearchQA (66.1%), por encima de Gemini 3 Pro “base”.

Google está empaquetando investigación + herramientas + evaluación en una misma oferta para devs. Eso baja fricción para integrar investigación rigurosa (con trazas, re‑querying y cobertura) dentro de agentes y apps.

Fuente: [clic aquí]

GitHub: el desarrollo entra en modo “multi‑agent”

VS Code 1.107 introduce orquestación multi‑agente: usar GitHub Copilot junto a agentes personalizados para acelerar y paralelizar desarrollo.

La idea clave es la delegación por tipo de agente y por dónde corre: local, en segundo plano (workspaces aislados) o en la nube. Esto reduce interrupciones (tu editor sigue libre) y permite ejecutar múltiples tareas en paralelo (p.ej., un agente refactoriza mientras otro corre pruebas o prepara documentación).

Puntos destacados del anuncio:

- Agent HQ centraliza la gestión de agentes y colaboración entre Copilot y agentes custom.

- Background agents en workspaces aislados para no interferir con tu trabajo activo.

- Posibilidad de delegar entre agentes locales, en background o cloud para mantener el flujo sin cortes.

-

GitHub prepara un hub para múltiples agentes de programación (Agent HQ) que centralice el agente de Copilot y opciones de terceros.

Esto sugiere un cambio de patrón: del asistente en el editor a un workspace con varios agentes especializados (tests, refactor, review, documentación) y posibilidad de elegir proveedor según tarea/política. Para equipos, un hub también facilita gobernanza: qué agentes se permiten, con qué permisos y en qué repos.Fuente: [clic aquí]

Breve Análisis de QUÉ está cambiando

Del chat al trabajo: el gran salto de los agentes

Durante 2025, el mercado se movió de asistentes conversacionales a sistemas que planifican y ejecutan (con herramientas, memoria, flujos y supervisión). El resultado: la UX se desplaza desde una caja de texto a interfaces y superficies (Teams, Windows, hubs de desarrollo, etc.).

La próxima batalla: control, permisos y trazabilidad

El problema ya no es si el agente puede sino si debería, con qué permisos y cómo auditas lo que hizo.

Tres conceptos que se repiten en las últimas semanas:

- Control plane / governance (políticas, límites, aprobaciones)

- Conectores/protocolos para herramientas y contexto (ej. MCP)

- Evaluación realista (benchmarks que simulan entornos, no solo preguntas)

Desde la Investigación (arXiv, última semana)

Merece la pena echar un vistazo a los siguientes artículos:

Confucius Code Agent (agente de ingeniería de software a escala industrial) — preprint (11 dic 2025).

https://arxiv.org/abs/2512.10398

Presenta un agente de programación open‑source pensado para repositorios grandes y sesiones largas, combinando memoria de trabajo jerárquica, notas persistentes entre sesiones y un sistema modular de herramientas. Incluye un “meta‑agent” que automatiza ciclos build → test → improve para ajustar configuraciones del agente. Reportan 54.3% Resolve@1 en SWE‑Bench‑Pro, como señal de madurez hacia escenarios industriales.

Automatización de GUI con agentes (razonamiento conjunto + reflexión grupal) — “GAIR” (10 dic 2025).

https://arxiv.org/abs/2512.09396

Propone un framework de automatización de interfaces (GUI) que orquesta varios MLLMs especializados y un modelo generalista que fusiona evidencias (“information‑joint reasoning”). Cuando falta información, entra en modo group reflection, distribuyendo instrucciones distintas a cada modelo según sus fortalezas para recopilar señales más útiles. Lo evalúan en benchmarks de GUI y reportan mejoras en efectividad y fiabilidad.

Comparativa agentes vs. profesionales en pentesting real (útil para risk/compliance) — (10 dic 2025).

https://arxiv.org/abs/2512.09882

Primer estudio comparando agentes con pentesters humanos en un entorno empresarial real (red universitaria de ~8.000 hosts). Evalúan 10 profesionales, 6 agentes existentes y ARTEMIS, un scaffold multi‑agente con generación dinámica de prompts, sub‑agentes arbitrarios y triage automático. ARTEMIS queda 2º (9 vulnerabilidades válidas, 82% de validez) y muestran ventajas en enumeración/paralelización y coste, pero aún sufren en falsos positivos y tareas con GUI.

Towards a Science of Scaling Agent Systems — sobre cómo escalar sistemas agentic (9 dic 2025).

https://arxiv.org/abs/2512.08296

Intenta formalizar “leyes de escalado” para sistemas de agentes con un estudio controlado (180 configuraciones) variando topologías (single/independent/centralized/decentralized/hybrid), herramientas y presupuestos. Identifican tres efectos: (1) en tareas tool‑heavy, el overhead multi‑agente penaliza; (2) hay saturación: si un solo agente ya es fuerte, coordinar puede no compensar; (3) la topología afecta a la amplificación de errores (independientes amplifican más, centralizados contienen mejor). Proponen métricas de coordinación para predecir la estrategia óptima.

Security and Safety in the Model Context Protocol Ecosystem — seguridad/safety alrededor de MCP (9 dic 2025).

https://arxiv.org/abs/2512.08290

Una SoK que trata MCP como la “USB‑C para agentes” y alerta de que al conectar contexto + ejecución, se difumina la frontera entre alucinación y brecha de seguridad (acciones no autorizadas). Propone una taxonomía de riesgos (p.ej. indirect prompt injection, envenenamiento de herramientas) y analiza vulnerabilidades en primitivas de MCP (Resources, Prompts, Tools). Revisa defensas (proveniencia criptográfica, verificación de intención en runtime) y cierra con una hoja de ruta para pasar de chatbots a “agentic operating systems” con controles sólidos.

Modelos de IA Interesantes (lanzamientos y tendencias)

Mosaico rápido de modelos y releases recientes que merece la pena tener en cuenta:

Google Gemini 3 (lanzamiento) — nuevo flagship de Google según cobertura de prensa, con foco en capacidades generalistas y despliegue en productos (app + Search).

Fuente: [clic aquí]

Modelos open‑weight en el foco público (ej. Apertus / Suiza) — señal de que gobiernos/consorcios siguen empujando alternativas abiertas orientadas a confianza y adopción regional.

Fuente: [clic aquí]

Transformers v5 (Hugging Face) — no es un modelo como tal, pero es un release de infraestructura clave con definiciones más simples y mantenimiento del ecosistema (impacta de lleno a equipos que entrenan/fine‑tunean y sirven modelos locales).

Fuente: [clic aquí]

Diffusers + FLUX‑2 (Hugging Face) — actualización relevante para generación de imagen (útil para equipos que produzcan creatividades internas o pipelines de contenido).

Fuente: [clic aquí]

Tendencias en modelos para usar en local (Hugging Face Trending) — el ranking cambia a diario, pero es un buen termómetro para descubrir modelos nuevos (LLMs, VLMs, TTS, etc.) que la comunidad está probando ahora mismo:

1.- microsoft/VibeVoice-Realtime-0.5B:

Modelo de Text-to-Speech en tiempo real pensado para streaming (latencia de primer audio ~300 ms, dependiente de hardware) y generación de voz en sesiones largas. Ideal para TTS “en vivo” (lectura de eventos, narración de dashboards, asistentes que empiezan a hablar sin esperar a que el LLM termine). Es pequeño y orientado a despliegue. Limitación relevante: variante mono‑locutor. Tamaño: 0.5B parámetros.

2.- zai-org/GLM-4.6V-Flash:

VLM multimodal (imagen+texto) “ligero” para despliegue local y baja latencia, dentro de la familia GLM‑V. Pensado para agentes multimodales con Function Calling nativo (cerrando el bucle “percibir → entender → ejecutar”), buen rendimiento en comprensión visual, documentos y UI (OCR/layout/charts) y soporte de contexto largo. Tamaño: ~9B.

3.- zai-org/GLM-4.6V:

VLM multimodal de mayor escala, orientado a cloud/cluster, con foco en razonamiento visual y escenarios empresariales. Destaca por contexto largo (hasta 128k en entrenamiento), generación intercalada imagen‑texto, comprensión de documentos y replicación/edición de frontends a partir de capturas. También integra Function Calling nativo para agentes multimodales. Tamaño: 106B.

4.- EssentialAI/rnj-1-instruct:

LLM instruct (denso) entrenado “from scratch” por Essential AI, optimizado para código y STEM. Muy fuerte en agentes de programación (reportan buen rendimiento en mini‑SWE‑agent) y tool-calling; buenas capacidades en matemáticas/ciencia y soporte de long context (32k). Tamaño: 8B.

5.- deepseek-ai/DeepSeek-V3.2:

LLM grande enfocado en razonamiento eficiente y rendimiento en tareas agentic, con cambios en plantilla de chat y soporte de “thinking with tools”. Introduce DeepSeek Sparse Attention (DSA) para bajar coste en contexto largo, un protocolo de RL escalable y un pipeline de síntesis de tareas agentic para mejorar tool use y generalización en entornos interactivos. Tamaño: 685B.

6.- salakash/SamKash-Tolstoy:

LoRA/PEFT adapter especializado en estilo de literatura rusa (en inglés) sobre una base pequeña. Útil para escritura creativa (voz “Tolstoy/Dostoevsky”, temas, monólogos, estilo 19º siglo) y como demo educativa de adaptación de dominio con LoRA. No está pensado para factualidad ni tareas modernas de código.

Tamaño: base 1.5B (finetuned dedeepseek-ai/DeepSeek-R1-Distill-Qwen-1.5B; el adapter es LoRA y el tamaño de pesos adicionales depende de la configuración LoRA).7.- mistralai/Devstral-2-123B-Instruct-2512:

LLM instruct grande orientado a agentic coding (software engineering agents) y uso intensivo de herramientas. Mejora frente a versiones previas en rendimiento y generalización; pensado para explorar codebases, editar múltiples ficheros y operar con scaffoldings tipo Cline/OpenHands/SWE‑Agent. Incluye context window 256k. Tamaño: 123B.

Fuente: [clic aquí]

Algunas Noticias Breves de IA

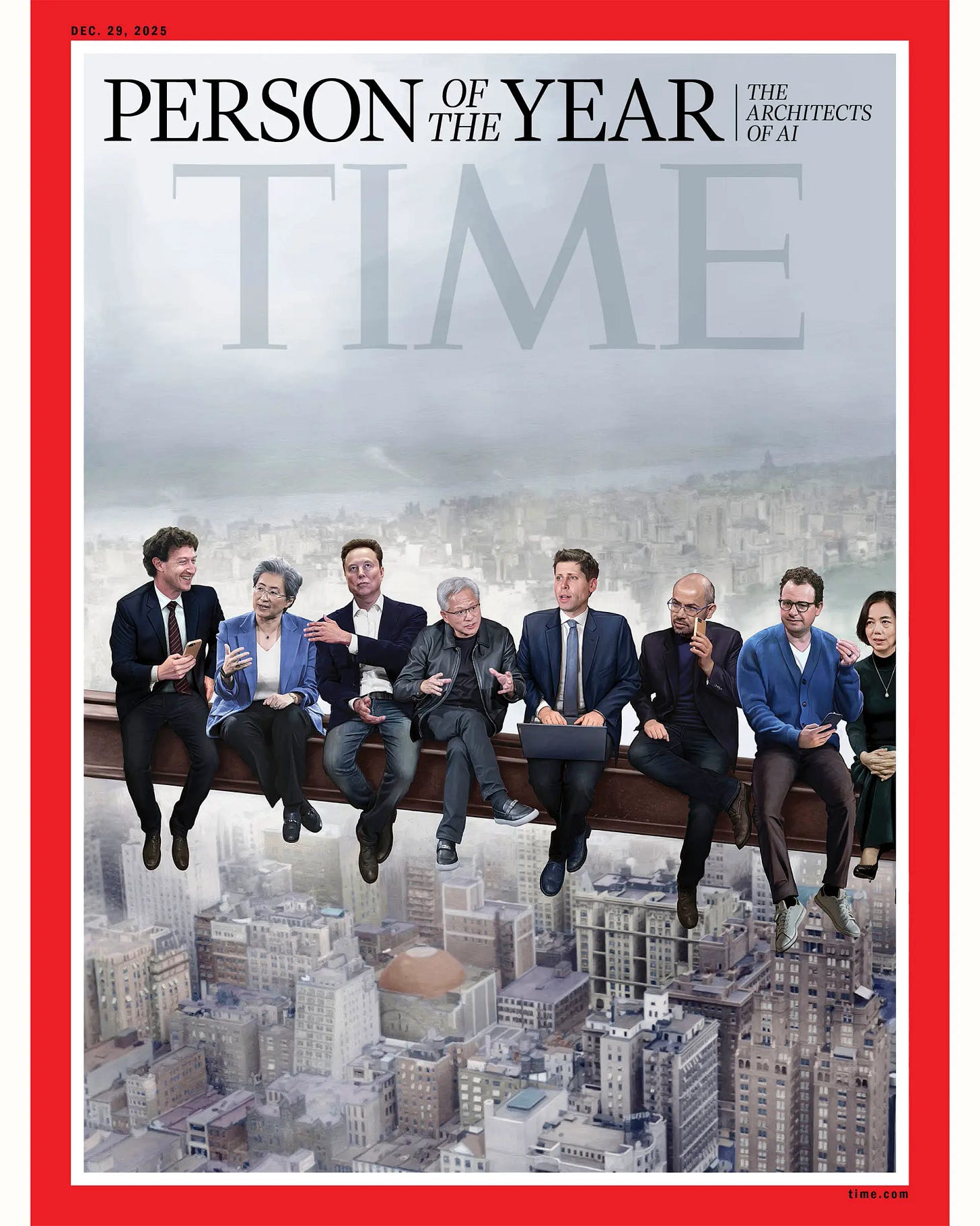

TIME Magazine nombró a “los arquitectos de la IA” como Person of the Year 2025, destacando a Jensen Huang, Sam Altman, Dario Amodei y Elon Musk.

Fuente: [clic aquí]

Cursor presentó un nuevo editor visual para arrastrar/reordenar elementos de UI mientras agentes actualizan el código subyacente.

Fuente: [clic aquí]

Shopify lanzó nuevas funciones Winter ’26 AI, incluyendo SimGym para simular comportamiento de compra y Agentic Storefronts.

Fuente: [clic aquí]

Runway anunció GWM‑1, su primer “General World Model” para simular entornos interactivos en tiempo real.

Fuente: [clic aquí]

Google Labs lanzó Disco, un navegador experimental que usa Gemini 3 para generar apps web a partir de tus pestañas y tareas.

Fuente: [clic aquí]

- ElevenLabs anunció una colaboración con Meta para llevar su tecnología de audio/voz a creadores en Instagram, Horizon y más.

Si 2024 fue el año del copilot, 2025 está cerrando como el año del “colega digital”: agentes que no solo sugieren, sino que operan (con costes, riesgos y nuevas responsabilidades). La ventaja competitiva ya no es solo el modelo: es la arquitectura, el gobierno y la evaluación.