En Resumen: lo imprescindible

Los Agentes de IA avanzan de features a plataformas (y de chat a operaciones)

- La capa agéntica para desarrolladores se vuelve producto: OpenAI empuja un ecosistema de apps (directorio/app store de ChatGPT) y saca un modelo de coding dedicado (GPT‑5.2‑Codex).

- Del prompt a la interfaz: empieza a consolidarse la capa crear/editar con agentes (Figma en ChatGPT para assets y slides; editores visuales tipo Cursor Browser) donde el output ya es un artefacto editable, no solo texto.

- El salto multimodal continúa, pero ya con foco operativo: imágenes en ChatGPT y avances en audio/visión apuntan a agentes que necesitan ver, oír y actuar de forma fiable.

- Gobierno y seguridad se endurecen: esta semana el tema dominante es menores / bienestar / compliance (protecciones y predicción de usuarios menores, marcos de cumplimiento regulatorio).

- Tooling y estándares para herramientas: además de FunctionGemma/Interactions API, gana tracción MCP con el repo oficial de Google (servidores, guías y ejemplos para desplegar herramientas de verdad).

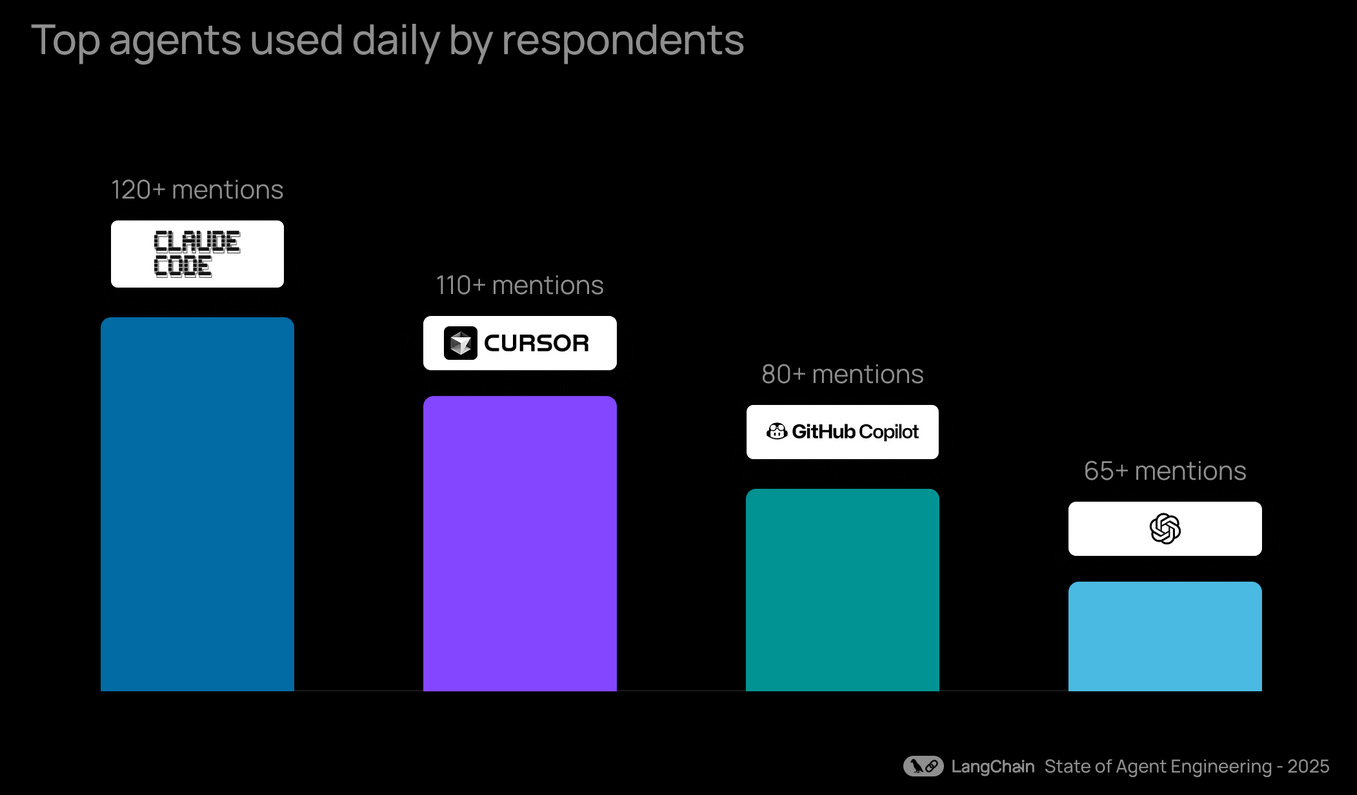

- Agent engineering ya es una disciplina: el estudio “State of Agent Engineering” (LangChain) pone números a la realidad: la producción sube, pero la calidad y la latencia mandan; observabilidad y evals se vuelven imprescindibles.

- La investigación se centra en lo que rompe agentes en producción: memoria y auto‑evolución sin re‑entrenar (MOBIMEM), evaluación de búsqueda difusa en web (Needle in the Web) y cuándo multi‑agente ayuda (y cuándo no).

Noticias Recientes

LangChain: “State of Agent Engineering” (encuesta 2025)

LangChain publica su estudio “State of Agent Engineering” (encuesta a 1.300+ profesionales) sobre cómo se están construyendo y desplegando agentes.

Entre los principales hallazgos se encuentran que 57% ya tiene agentes en producción; el mayor freno es calidad (32%); la observabilidad está a la orden del día (~89% la ha implementado) y las evaluaciones aún van por detrás (~52% reporta offline evals). Además, usar múltiples modelos es lo normal (sin apostar por un único proveedor) y el fine‑tuning no está ampliamente adoptado.

Esto confirma que la conversación del mercado pasa de prototipos a operación a escala, y que la ventaja competitiva está menos en qué modelo y más en la disciplina de agent engineering: trazas, evals, routing multi‑modelo, control de latencia y (en enterprise) seguridad.Fuente: [clic aquí]

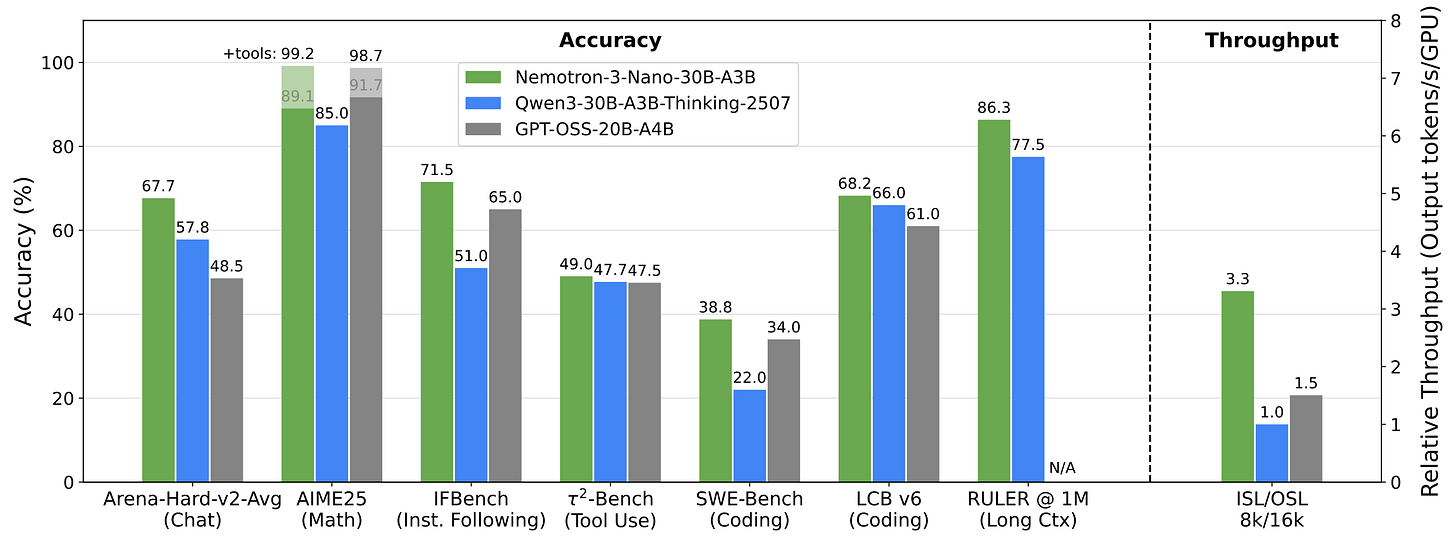

NVIDIA: Nemotron 3 Nano (open weights) para agentes eficientes

NVIDIA publica Nemotron 3 Nano 30B (A3B, BF16) en Hugging Face.

Lo interesante aquí no es solo que es otro LLM más, sino la dirección de producto, ya que es un modelo pensado explícitamente para construir agentes especializados con foco en eficiencia (arquitectura híbrida MoE + Mamba‑2 + atención, con 3.5B parámetros activos / 30B totales) y con modos configurables de razonamiento (thinking on/off y presupuestos). Esto encaja con la tendencia de la semana: más capacidad agéntica con coste/latencia controlables.Fuente: [clic aquí]

OpenAI: ecosistema (apps), multimodal (imágenes) y coding agents (Codex)

OpenAI lanza “ChatGPT Images” (generación/edición de imágenes desde ChatGPT).

Se refuerza el patrón en el que el agente ya no es solo texto, ya que cada vez más tareas reales (contenidos, prototipos, documentación visual) piden un loop “pedir → generar → revisar → iterar” dentro del mismo flujo de trabajo.Fuente: [clic aquí]

OpenAI abre su ecosistema de apps en ChatGPT (envío de apps al directorio).

Para agentes, esto importa por dos razones: (1) estandariza distribución/descubrimiento de capacidades (conectores, utilidades, verticales) y (2) empuja a pensar en permisos, revisión y calidad como parte del go‑to‑market del agente.Fuente: [clic aquí]

OpenAI publica investigación sobre monitorización de chain‑of‑thought (monitorability).

En agentic systems, esto conecta con un problema real: cómo inspeccionar/asegurar comportamientos sin depender de confiar ciegamente en los agentes. La dirección apunta a controles más medibles en runtime.Fuente: [clic aquí]

Seguridad, menores y bienestar: el gran tema de la semana

OpenAI actualiza su Model Spec con protecciones específicas para adolescentes.

Es una pista práctica de diseño: si tu producto toca público joven, el tono y la utilidad pasan a segundo plano frente a objetivos de seguridad (p.ej., promover apoyo fuera de la app, transparencia y límites).Fuente: [clic aquí]

OpenAI publica recursos de alfabetización en IA para adolescentes y familias.

Más allá del contenido, es señal de que el proveedor asume responsabilidades de educación/uso responsable como parte del stack.Fuente: [clic aquí]

OpenAI y Anthropic se mueven hacia detección/estimación de usuarios menores (cobertura de prensa).

Esto apunta a una capa de restricción por edad probabilística que, si se normaliza, afectará a producto (UX), a privacidad y a compliance.Fuente: [clic aquí]

Anthropic publica un marco de cumplimiento para la ley de transparencia de IA frontier en California (SB53) y también un post sobre bienestar de usuarios.

En conjunto, refuerzan el mensaje de que para vender agentes en empresa o sector regulado, el roadmap ya incluye compliance por diseño.Fuentes: [clic aquí] [aquí]

Google: agentes para devs + function calling en el edge

Google publica FunctionGemma (function calling a medida orientado a despliegue en el borde).

Es importante porque baja la latencia/coste del “percibir → decidir → invocar herramienta” y permite agentes más locales (menos dependencia de cloud para acciones simples).Fuente: [clic aquí]

Google acelera Gemini 3 Flash para desarrolladores.

Se optimiza no solo por capacidad, sino por “capacidad por dólar/latencia”, que es lo que manda en agentes con tool use frecuente.Fuente: [clic aquí]

Google sigue empujando la Interactions API (models + agents unificados) y publica contenido de formación de agentes.

Esto consolida un patrón de plataforma: modelos + agentes + conectores en una misma superficie.Fuentes: [clic aquí] [aquí]

Ecosistema open y tooling, componentes que habilitan agentes en local

Hugging Face publica Tokenizers en Transformers v5 (simplificación/modularidad) y recetas de evaluación para modelos agénticos eficientes (Nemotron 3 Nano).

El impacto directo ha sido menos fricción para servir modelos y construir pipelines reproducibles (clave cuando un agente vive en producción y hay que depurar/actualizar rápido).Fuentes: [clic aquí] [aquí] [o aquí]

Nuevas Interfaces con Agentes (crear y editar con agentes)

Figma en ChatGPT (Buzz + Slides): la app de Figma en ChatGPT permite convertir prompts en assets visuales (Figma Buzz) y presentaciones (Figma Slides) que luego se refinan dentro de Figma. La idea clave es el puente “conversación → artefacto editable”, donde el agente arranca el trabajo y el usuario termina con control fino.

Fuente: [clic aquí]

DragGANAI: un ejemplo claro de la dirección de “drag and edit” (en vez de describirlo todo con texto). Aunque sea un demo, anticipa un patrón que veremos más, la manipulación directa de lo generado (gestos/poses/formas) con inputs simples, y el modelo resolviendo el cómo sin exigir herramientas de diseño tradicionales.

Fuente: [clic aquí]

Cursor Browser: editor visual: Cursor añade un editor visual para su navegador donde puedes reordenar elementos, tocar props/estados de componentes y ajustar estilos con controles visuales; luego el agente aplica esos cambios en el código. Es un paso más hacia “UI‑first agent building”: cambias el resultado y el agente retro‑propaga al repositorio.

Fuente: [clic aquí]

Estos lanzamientos empujan el mismo cambio de fondo, y es que los agentes dejan de ser solo chats y pasan a ser interfaces de producción. Cuando la salida del modelo es un objeto editable (slide, asset, UI real), baja la fricción de iterar y sube la confiabilidad (porque revisar/corregir es más tangible que discutir texto).

Desde la Investigación (arXiv, última semana)

Merece la pena echar un vistazo a los siguientes artículos:

MOBIMEM: auto‑evolución de agentes sin re‑entrenar (15 dic 2025).

Fuente: [clic aquí]

Proponen una arquitectura memory‑centric con memorias separadas (perfil/experiencia/acciones) y servicios tipo SO (scheduler, record‑and‑replay, manejo de excepciones). Reportan mejoras en éxito y latencia en entornos móviles (AndroidWorld), empujando la idea de que mucha mejora de agente puede venir de memoria/ejecución, no de retocar pesos.

Needle in the Web: benchmark para búsqueda web “difusa” (18 dic 2025).

Fuente: [clic aquí]

Benchmark de 663 preguntas orientado a consultas ambiguas/exploratorias donde el objetivo es encontrar la página correcta (no solo responder un hecho). Evalúan LLMs y agentes de búsqueda y encuentran que muchos quedan por debajo de ~35% de acierto, subrayando que la búsqueda real (ambigua) sigue siendo un punto débil.

¿Cuándo multi‑agente ayuda? Evaluación en geometría con diagramas (18 dic 2025).

Fuente: [clic aquí]

Comparan single‑agent vs multi‑agent en benchmarks de matemáticas visuales. Reportan mejoras consistentes para modelos open‑source (p.ej., Qwen‑2.5‑VL 7B/32B) pero no un beneficio universal para modelos cerrados fuertes; la ganancia aparece más en datasets nuevos/menos familiares.

Tool calling eficiente con modelos pequeños (SLMs) (17 dic 2025).

Fuente: [clic aquí]

Exploran fine‑tuning dirigido de un SLM (opt‑350m) y reportan un 77.55% de pass rate en ToolBench, por encima de varios baselines. Si se sostiene en escenarios reales, refuerza la tesis “local/pequeño pero afinado” para tool‑calling frecuente.

KalshiBench: medir calibración epistémica con prediction markets (17 dic 2025).

Fuente: [clic aquí]

Benchmark basado en preguntas con resultados verificables posteriores al corte de entrenamiento. Encuentran sobreconfianza sistemática y muestran que más razonamiento no implica mejor calibración. Para agentes, esto es crucial, ya que saber cuándo escalar/consultar/hacer fallback es parte del producto.

Modelos de IA Interesantes (lanzamientos y tendencias)

GPT‑5.2‑Codex (OpenAI) — modelo dedicado a programación/agentic coding.

Fuente: [clic aquí]

ChatGPT Images (OpenAI) — generación/edición de imágenes desde ChatGPT (mejora el loop multimodal del agente).

Fuente: [clic aquí]

Gemini 3 Flash (Google) — empuje a modelos rápidos/escalables para apps y agentes.

Fuente: [clic aquí]

FunctionGemma (Google) — function calling orientado a despliegue en edge.

Fuente: [clic aquí]

Nemotron 3 Nano (NVIDIA, vía Hugging Face) — enfoque en eficiencia/agentic.

Fuentes: [clic aquí] [aquí]

SAM Audio (Meta, vía Hugging Face) — modelo unificado de separación de audio que permite aislar sonidos en mezclas complejas usando prompts de texto, visuales y también “span prompting” (segmentación basada en un tramo/instante del vídeo que contiene el audio objetivo). La colección incluye varios tamaños y benchmarks/datasets asociados; hay demo interactiva.

Fuentes: [clic aquí] [aquí] [o aquí]

CUGA (IBM Research) — agente configurable y open-source orientado a casos de uso enterprise, con foco en tareas multi‑paso sobre web y APIs, integración con herramientas (incl. OpenAPI specs) y soporte explícito de MCP servers; disponible también como demo en Hugging Face Spaces.

Fuente: [clic aquí]

HyperNova 60B (Multiverse Computing) — modelo “comprimido y optimizado” (CompactifAI) basado en GPT‑OSS‑120B; la empresa reporta mejoras vs Mistral 3 Large en inteligencia/eficiencia (p.ej., -92% memoria, 2.8× throughput, +65% latencia).

Fuente: [clic aquí]

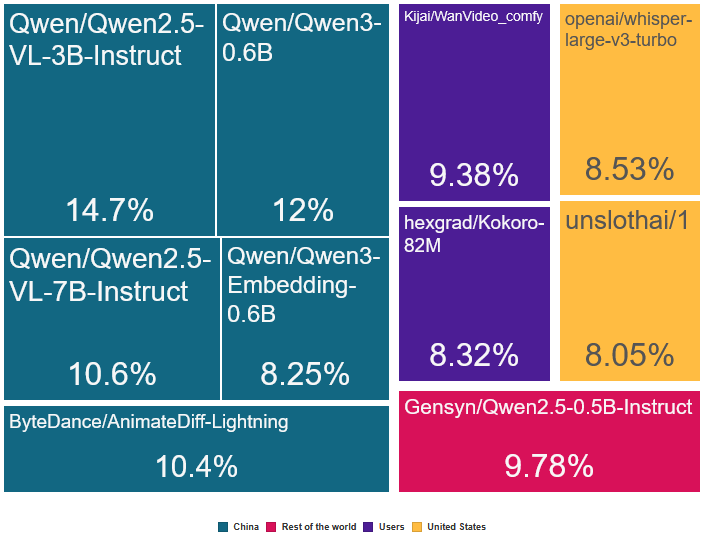

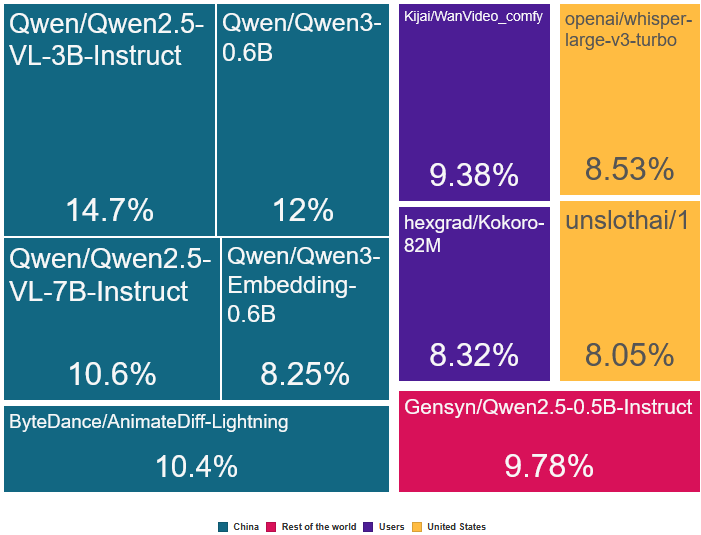

¿Qué modelos open-source fueron más descargados en 2025?

Algunas Noticias Breves de IA

El Gobierno de España impulsa ALIA poniendo a disposición del ecosistema el modelo ALIA 40B Instruido (40.000 millones de parámetros), alineado con datos e instrucciones adaptados a características socioculturales de España; el anuncio se enmarca en la jornada “Impulsando el ecosistema de IA” y el prompt-a-thon “Desafío ALIA” (Algoritmos Verdes).

Fuente: [clic aquí]

Google publica su repositorio oficial de MCP con listado de servidores (remotos y open‑source), recursos para desplegarlos (p.ej., en Cloud Run) y ejemplos reales. Incluye integraciones como Google Maps, Google Analytics y Google Workspace (Docs/Sheets/Slides/Calendar/Gmail) entre otras.

Fuente: [clic aquí]

Disney y OpenAI alcanzan un acuerdo de licencia (3 años) para llevar Sora a personajes de Disney/Marvel/Pixar/Star Wars, con vídeos cortos generados a partir de prompts de fans (y una selección disponible en Disney+). El anuncio también incluye que Disney usaría las APIs de OpenAI para nuevos productos y ChatGPT para empleados.

Fuente: [clic aquí]

La Universidad de Jaén se sitúa como la segunda mejor de España por impacto e influencia de sus publicaciones científicas (Informe CYD 2025), destacando en áreas como energías renovables, sostenibilidad y medio ambiente.

Fuente: [clic aquí]

OpenAI anuncia “OpenAI Academy for News Organizations” (formación/soporte para redacciones).

Fuente: [clic aquí]

UPS usa robots y ML para detectar devoluciones fraudulentas (aplicación industrial del “agentic warehouse”).

Fuente: [clic aquí]

YouTube termina canales que monetizaban trailers fake generados con IA (otra señal de endurecimiento contra engaño).

Fuente: [clic aquí]