En Resumen: lo imprescindible

La carrera agéntica se decide por seguridad, latencia y producto.

- La seguridad para “agents in the browser” entra en modo industrial: OpenAI explica cómo está endureciendo ChatGPT Atlas contra prompt injection con red teaming automatizado y un loop rápido de descubrimiento→parche.

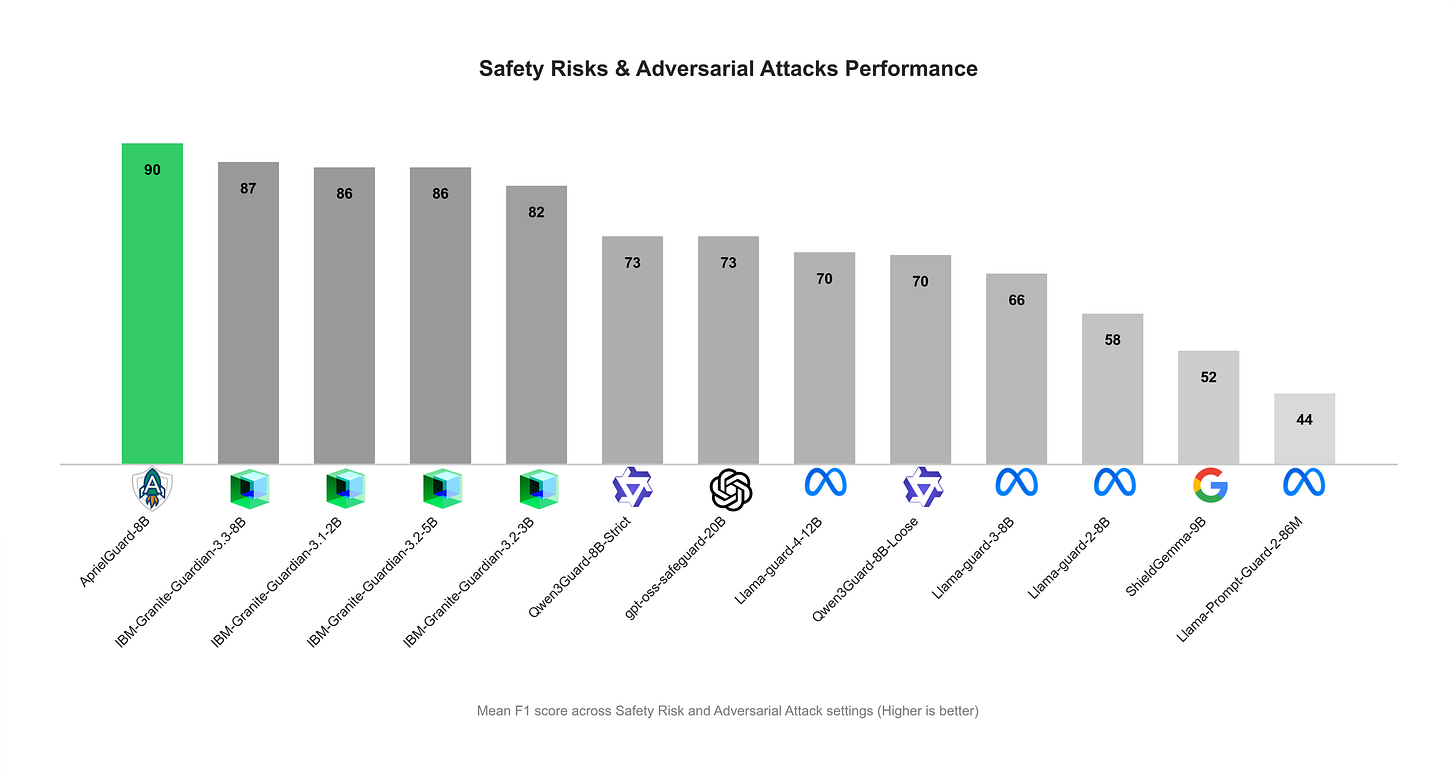

- La capa de guardrails se vuelve más específica para agentes: AprielGuard (8B) se presenta como modelo unificado para riesgos de seguridad + ataques adversariales (prompt injection, memory poisoning, tool manipulation) en flujos agénticos.

- Infra y coste/latencia de inferencia siguen dictando lo posible: Groq anuncia un acuerdo de licencia no exclusivo con NVIDIA para tecnología de inferencia (y movimiento de parte del equipo para escalarla).

- 2025 se cierra con recaps que ya hablan de agentic capabilities como producto, no como demo: Google publica su recap anual y su resumen del año de avances (modelos, herramientas de dev y agentes).

- Agentes visibles en UX real: desde resumen del año en ChatGPT hasta un posible asistente in‑car para Waymo (Gemini) encontrado en el código de la app.

- Riesgo y gobernanza vuelven a primer plano: aparece el rol explícito de preparedness como función ejecutiva para capacidades frontier y mitigación operativa.

Noticias Recientes

OpenAI: “agents in the browser” y el problema real del prompt injection (ChatGPT Atlas)

OpenAI publica cómo está endureciendo ChatGPT Atlas contra ataques de prompt injection (22 dic 2025).

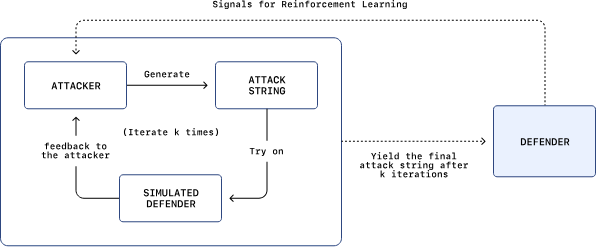

El mensaje importante para equipos que están metiendo agentes en navegador es que el vector de ataque no es un bug, sino el propio patrón en el que el agente consume contenido no confiable (email, docs, webs) y puede ser manipulado para ejecutar acciones (enviar emails, editar ficheros, etc.).La parte técnica destacable es el enfoque en el que un atacante automatizado basado en LLM entrenado end‑to‑end con RL para descubrir clases nuevas de ataques, usar simulación con trazas y, cuando encuentra algo, alimentar un ciclo de respuesta rápida (adversarial training + mejoras del stack) que termina en despliegue.

Fuente: [clic aquí]

Infra de inferencia: Groq + NVIDIA (licencia no exclusiva) y el coste/latencia como cuello de botella agéntico

Groq anuncia un acuerdo de licencia no exclusivo con NVIDIA para tecnología de inferencia (24 dic 2025).

A medida que sube el número de tool calls, navegación y pasos, el sistema vive o muere por latencia y coste. Este tipo de acuerdos (y el foco explícito en inferencia high‑performance, low cost) es la otra cara de la moneda de agentes cada vez más capaces.Fuentes: [clic aquí] [aquí]

Google: cierre de año con “agentic capabilities” como línea principal

Google publica “60 of our biggest AI announcements in 2025” (22 dic 2025).

Es un recap, pero útil para ver qué se está consolidando como plataforma. Entre ellos, Gemini (incl. Flash), Search/AI Mode, Android, NotebookLM, tooling de dev y modelos/infra. En la práctica, es una guía rápida de qué integraciones y superficies de producto van a definir 2026.Fuente: [clic aquí]

Google publica su resumen del año de avances de investigación (incl. agentes) (23 dic 2025).

En el texto ya aparece el marco de herramienta a utilidad, es decir, modelos que razonan + sistemas que actúan. Señalan explícitamente avances en capacidad agéntica en desarrollo de software y mencionan líneas de producto/labs relacionadas con agentes.Fuente: [clic aquí]

Z.ai (Zhipu): GLM-4.7 sube el listón en agentic coding

Z.ai publica GLM-4.7 y destaca mejoras en coding y tareas de terminal (22 dic 2025).

Lo más relevante para agentes de programación es que el post lo posiciona explícitamente como agente multilenguaje y con flujos de terminal, con mejoras en benchmarks tipo SWE-bench y Terminal Bench. También empuja una idea de producto importante para sistemas agénticos: thinking before acting y control por turno (activar/desactivar “thinking”) para balancear calidad vs latencia/coste.

Además, lo presentan como modelo utilizable tanto vía API (Z.ai) como en local (pesos en Hugging Face), y mencionan compatibilidad con herramientas y marcos de coding agents.

Fuente: [clic aquí]

Guardrails para agentes: AprielGuard (8B) como “safety + security” en un solo modelo

ServiceNow-AI presenta AprielGuard (8B) para seguridad y robustez adversarial en sistemas LLM modernos (23 dic 2025).

Lo relevante es el framing, ya no basta con moderar el contenido. En flujos agénticos aparecen ataques sobre el contexto, la memoria, el razonamiento y las herramientas. AprielGuard propone una taxonomía unificada y soporta formatos de entrada que se parecen más a producción (multi‑turn, tool calls, trazas de razonamiento).Fuentes: [clic aquí] [aquí] [o aquí]

Producto/UX: cuando el agente se ve y se vuelve parte del hábito

ChatGPT añade su resumen del año con estadísticas (22 dic 2025).

Más allá del wrapped, esto importa por producto porque normaliza que el sistema use memoria/personalización (si está habilitada) y crea una superficie de engagement que empuja a la retención, justo cuando los agentes compiten por ser el hub de trabajo.Fuente: [clic aquí]

Waymo estaría trabajando en un asistente in‑car basado en Google Gemini (24 dic 2025).

Si se confirma, es el patrón experiencia agéntica pero fuera del chat, con protocolos específicos (p.ej. protocolo de reafirmación) para situaciones reales, integrados en un producto con responsabilidades de seguridad.Fuente: [clic aquí]

Gobernanza y riesgo: “Preparedness” como función explícita

OpenAI busca un “Head of Preparedness” para riesgos frontier (27 dic 2025).

Independientemente del titular, es una señal de maduración organizativa, la seguridad y robustez pasan al pipeline operativo (evaluaciones, threat modeling, mitigaciones, despliegues).Fuente: [clic aquí]

Desde la Investigación (arXiv, última semana)

Merece la pena echar un vistazo a los siguientes artículos:

MAI-UI: Real-World Centric Foundation GUI Agents (26 dic 2025).

Fuente: [clic aquí]

Paper centrado en agentes GUI “de verdad”, con interacción usuario‑agente, operación más allá de UI‑only, arquitectura device‑cloud y robustez en entornos dinámicos. Mencionan explícitamente llamadas a herramientas MCP y reporta mejoras en benchmarks de grounding y navegación móvil.

AprielGuard (8B): safety + adversarial robustness para flujos agénticos (23 dic 2025).

Fuente: [clic aquí]

Interesante por el enfoque de unificar riesgos de seguridad y ataques adversariales en un solo guard model, con soporte de entradas tipo workflow (tool calls, trazas) más cercanas a producción.

Mindscape-Aware RAG (MiA-RAG): mejorar comprensión de contexto largo con visión global (19 dic 2025; destacado en 29 dic).

Fuente: [clic aquí]

Útil si estás construyendo agentes tipo deep research. Propone condicionar la recuperación y generación en una representación global construida por resumido jerárquico, para no perder el hilo en contextos largos.

Modelos de IA Interesantes (lanzamientos y tendencias)

AprielGuard (ServiceNow-AI) — guard model 8B para safety + security en workflows agénticos.

Fuentes: [clic aquí] [aquí] [o aquí]

MAI-UI (TongyiLab / Alibaba) — familia de foundation GUI agents (paper técnico; foco en despliegue real y colaboración device‑cloud).

Fuente: [clic aquí]

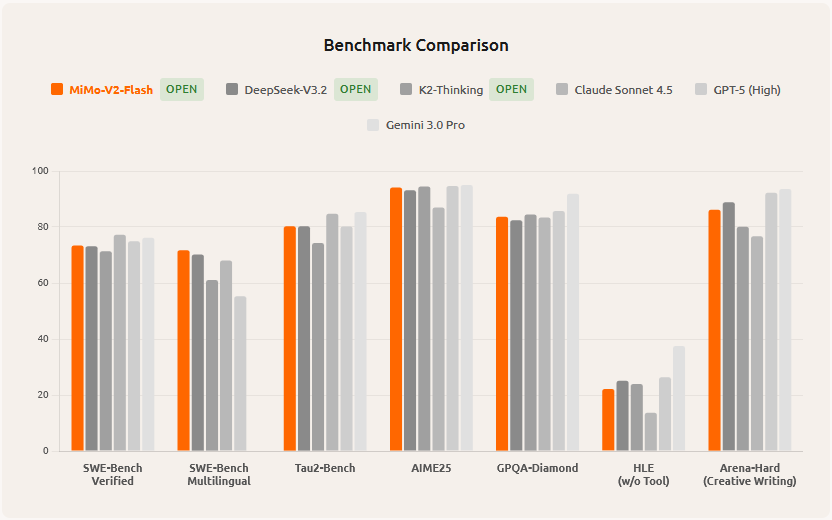

MiMo v2 Flash (Xiaomi) — lanzamiento de modelo orientado a eficiencia/velocidad.

Fuente: [clic aquí]

GLM-4.7 (Z.ai / Zhipu) — modelo centrado en coding y agentic coding (API + pesos públicos).

Fuentes: [clic aquí] [aquí]

MiniMax M2.1 (MiniMax) — modelo open-weights orientado a agentic coding; aparece como iteración sobre M2 y con foco en velocidad/eficiencia.

Fuente: [clic aquí]

Algunas Noticias Breves de IA

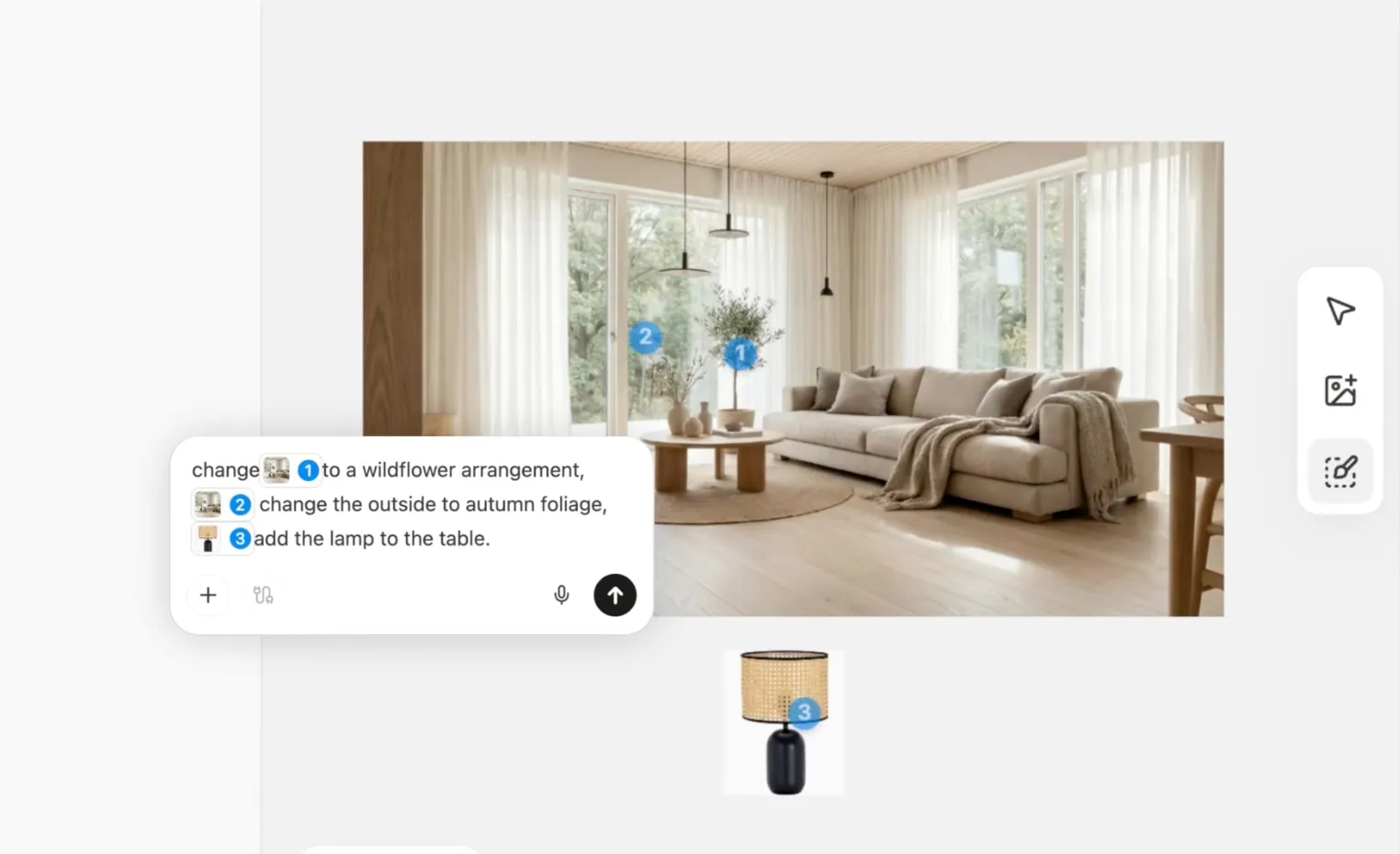

Manus presenta “Design View”, una forma de diseñar dentro del agente Manus con edición por selección (herramienta Mark), edición de texto y soporte móvil; disponible desde el 22 dic.

Fuente: [clic aquí]

OpenAI estaría desplegando “formatting blocks” en ChatGPT para que el draft se vea y edite como un documento/tarea (no solo chat), con una mini barra de edición al seleccionar texto.

Fuente: [clic aquí]