¡Feliz 2026 para todos! Que este año las buenas ideas nos pillen con el café todavía humeante y que cada commit tenga más chispa que las luces de fin de año.

En Resumen: lo imprescindible

La primera semana de 2026 llega con plataformas históricas vaciándose, reorganizaciones en hardware, cheques gigantes y reguladores tensando las costuras agentic.

- Stack Overflow se vacía: las preguntas caen 78% interanual mientras los desarrolladores migran a copilotos integrados en el IDE.

- Arm estrena Physical AI como tercer pilar junto a Cloud & AI y Edge, buscando posicionar su IP en robótica y automoción.

- El capital se recalienta: Anthropic persigue una ronda de $10B a $350B de valoración y xAI asegura $20B para acelerar Grok 5.

- Geopolítica de chips con Pekín frenando pedidos del H200 y empujando sustitutos domésticos.

- Gobiernos endurecen los guardrails: Reino Unido y la UE presionan a X por los deepfakes de Grok e Italia obliga a DeepSeek a advertir sobre alucinaciones antes de cerrar su investigación.

- Infraestructura y supply chain: Marvell compra XConn para switching acelerado y AWS+Aumovio llevan ingeniería agentic al despliegue comercial de camiones autónomos.

- OpenAI despliega Grove para formar fundadores sin idea previa con acceso temprano a sus modelos.

Noticias Recientes

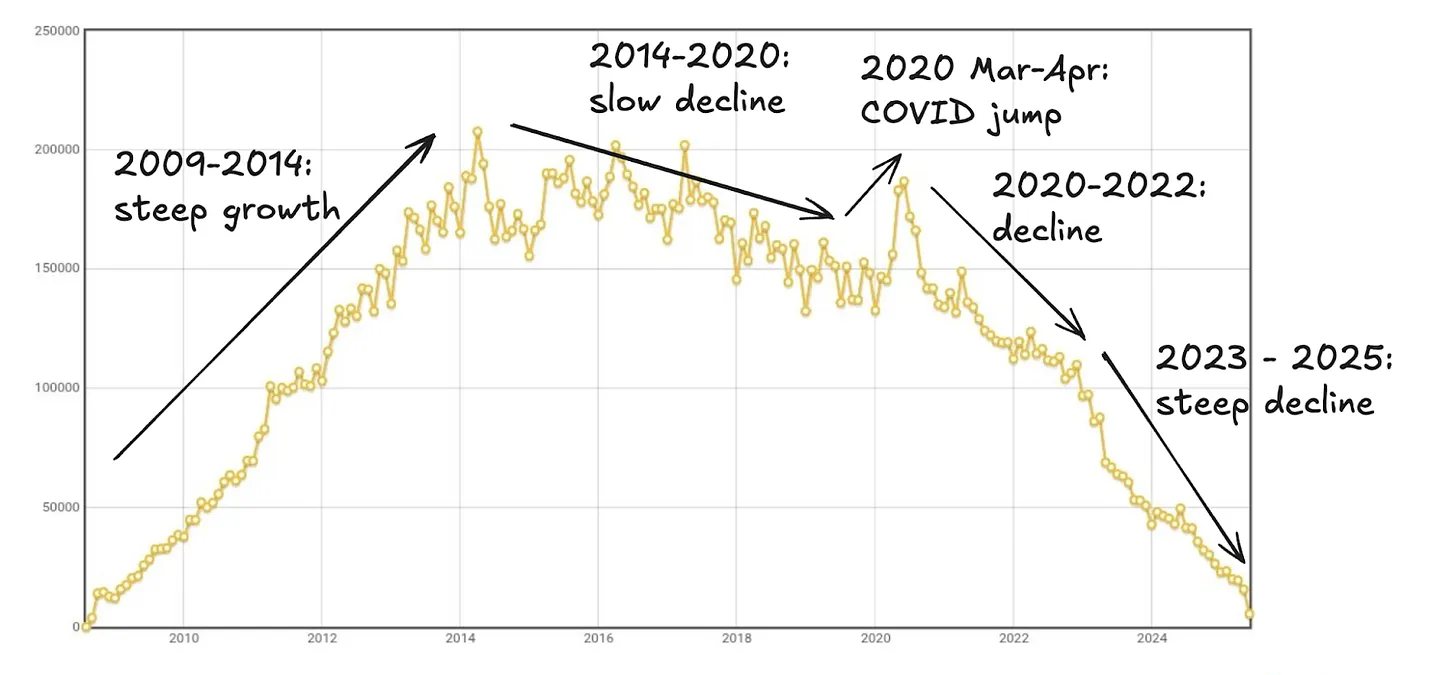

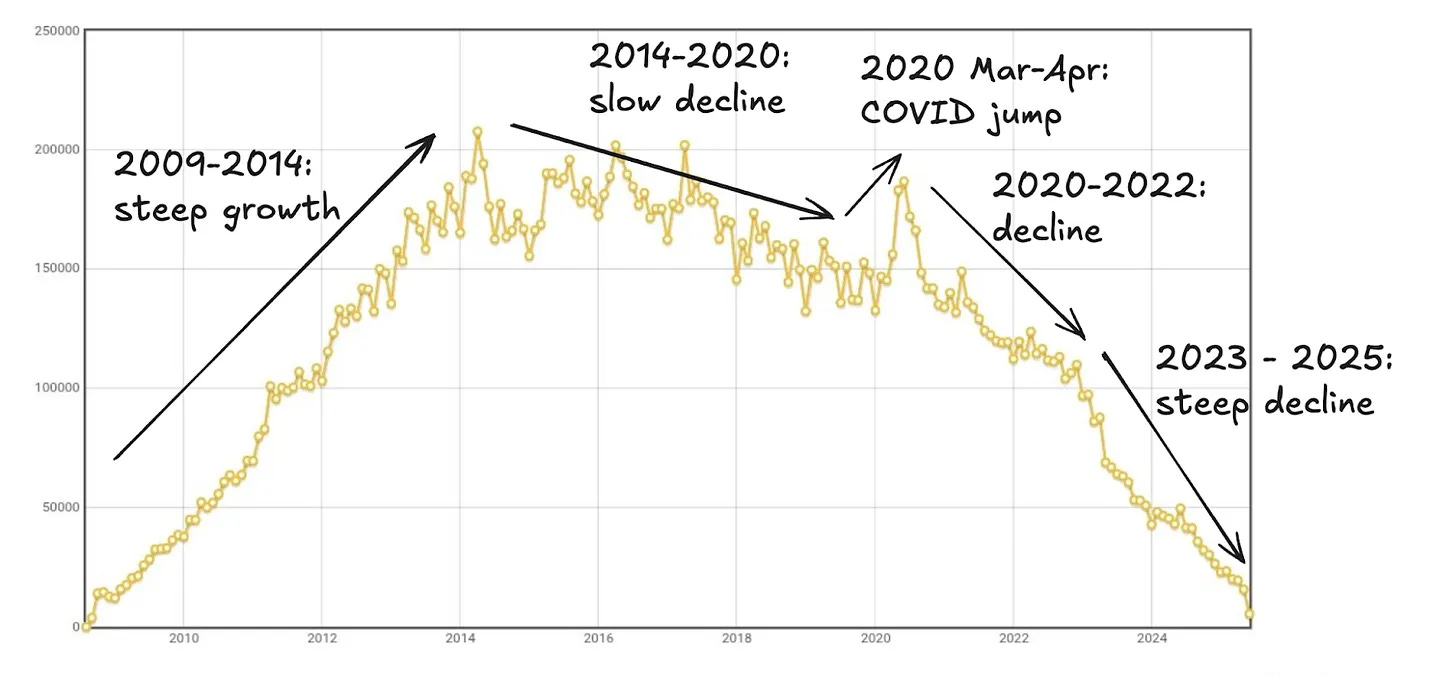

Las preguntas de Stack Overflow se desploman

Stack Overflow cerró diciembre de 2025 con 3,862 preguntas públicas, un descenso del 78% interanual y muy lejos del pico histórico de 200,000 preguntas mensuales registrado en 2014.

La combinación de asistentes de IA embebidos en IDEs y una comunidad percibida como hostil empuja a desarrolladores hacia otras fuentes, poniendo en duda indicadores como el ranking RedMonk que depende del tráfico de la plataforma.

Fuente: [clic aquí]

Arm reorganiza su apuesta por agentes físicos

Arm divide su negocio en Cloud & AI, Edge y la nueva unidad Physical AI, que integra robótica y automoción para escalar licencias y soporte técnico a fabricantes de humanoides y asistentes industriales.

Drew Henry dirigirá la división, que planea contratar más especialistas mientras clientes como Boston Dynamics muestran despliegues masivos de robots basados en Arm durante CES 2026.

Fuente: [clic aquí]

Anthropic busca $10B a una valoración de $350B

La compañía prepara una ronda liderada por GIC y Coatue que duplicaría su valoración desde septiembre (Series F a $183B) y la colocaría cerca de grandes capitalizaciones públicas.

Reuters indica que el cierre podría producirse en semanas, mientras Anthropic mantiene abierta la opción de un IPO en 2026 y sigue reforzando la adopción empresarial de Claude.

Fuente: [clic aquí]

China enfría los pedidos del H200 de Nvidia

Pekín pidió a varias tecnológicas que detengan esta semana nuevas órdenes del H200 mientras decide condiciones de acceso y empuja compras de chips nacionales.

El movimiento llega tras la autorización estadounidense condicionada a un impuesto del 25% sobre ingresos; Nvidia observa las órdenes como señal de aprobación mientras gestiona licencias de exportación.

Fuente: [clic aquí]

xAI cierra una Serie E de $20B y acelera Grok 5

Elon Musk anunció que xAI superó su objetivo de $15B con una ronda de $20B en la que entraron Valor Equity Partners, StepStone, Fidelity, QIA y socios estratégicos como Nvidia y Cisco.

Los fondos financiarán más cómputo y la fase de entrenamiento del modelo Grok 5; la compañía respondió a la prensa con el mensaje “Legacy Media Lies”, subrayando su narrativa anti medios.

Fuente: [clic aquí]

Reino Unido presiona a X por los deepfakes de Grok

La ministra Liz Kendall tildó de “absolutamente espeluznantes” las imágenes íntimas generadas bajo demanda y exigió medidas inmediatas contra el flujo de deepfakes que afectan sobre todo a mujeres y menores.

Ofcom contactó con X y xAI para revisar el cumplimiento de las obligaciones legales británicas, mientras la Comisión Europea califica el contenido de “ilegal” y Francia e India abren expedientes similares.

Fuente: [clic aquí]

Desde la Investigación (arXiv, última semana)

Merece la pena echar un vistazo a los siguientes artículos:

mHC: Manifold-Constrained Hyper-Connections (arXiv:2512.24880) (05 ENE 2026).

Fuente: [clic aquí]

Proponen Manifold-Constrained Hyper-Connections (mHC) como un marco general para mejorar las conexiones hiper-residuales en redes neuronales profundas. El objetivo es restaurar la propiedad de mapeo identidad de los residual connections mientras se diversifican los patrones de conectividad, mitigando así inestabilidades de entrenamiento y mejorando la escalabilidad y eficiencia. Los experimentos muestran mejoras prácticas en entrenamientos a gran escala, lo que sugiere nuevas direcciones en el diseño arquitectónico de modelos fundamentales.

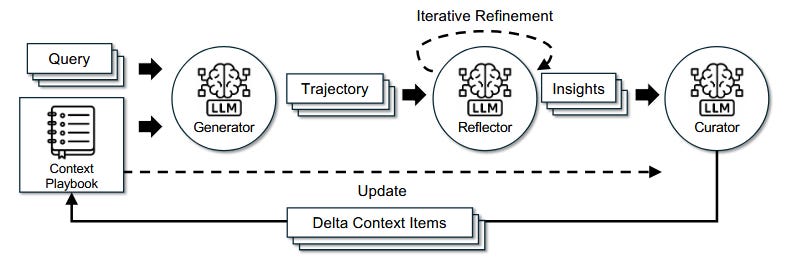

Agentic Context Engineering: Evolving Contexts for Self-Improving Language Models (arXiv:2510.04618) (06 ENE 2026).

Fuente: [clic aquí]

Introducen ACE (Agentic Context Engineering), un marco para que los LLMs mejoren sus contextos de entrada de forma evolutiva, acumulando, refinando y organizando estrategias a través de generación, reflexión y curación. ACE evita la collapse de contexto que ocurre con la reescritura iterativa tradicional y mantiene información detallada durante adaptaciones de contexto, con mejoras sustanciales en benchmarks de agentes (+10.6%) y aplicaciones especializadas sin necesidad de supervisión etiquetada (+8.6%).

DiffThinker: Towards Generative Multimodal Reasoning with Diffusion Models (arXiv:2512.24165) (30 dic 2025).

Fuente: [clic aquí]

Presentan DiffThinker, un nuevo paradigma de razonamiento multimodal que utiliza modelos de difusión en lugar de arquitecturas textocéntricas para tareas de visión y razonamiento espacial complejo. Reformulan el razonamiento multimodal como una tarea generativa image-to-image, logrando mejores resultados en precisión lógica, paralelismo nativo y control de procesos en comparación con MLLMs tradicionales, incluso contra GPT-5 (+314.2%) y Gemini-3 (+111.6%) en planificación, optimización combinatoria y configuración espacial.

Attention Is Not What You Need (arXiv:2512.19428) (22 DIC 2025).

Fuente: [clic aquí]

Este paper cuestiona la necesidad de la atención explícita (self-attention) en los modelos de secuencia como los Transformers. En lugar de atención, proponen una arquitectura basada en Grassmann flows que representa interacciones de tokens como subespacios geométricos de baja dimensión en una variedad de Grassmann, fusionándolos luego en estados ocultos con mezcla gated. Modelos basados en este enfoque alcanzan rendimientos competitivos en benchmarks clásicos de NLP con un coste lineal en la longitud de secuencia, abriendo nuevas rutas para comprensión geométrica del razonamiento.

DiRL: An Efficient Post-Training Framework for Diffusion Language Models (arXiv:2512.22234) (6 ENE 2026).

Fuente: [clic aquí]

Introducen DiRL, un marco eficiente de post-training para Diffusion Language Models (dLLMs) que combina entrenamiento bloqueado acelerado con FlexAttention junto con inferencia optimizada por LMDeploy. DiRL soporta un bucle de actualización online eficiente con entrenamiento supervisado seguido de aprendizaje por refuerzo. También presentan DiPO, una primera implementación de Group Relative Policy Optimization adaptada a dLLMs. El enfoque logra rendimiento de vanguardia en tareas de matemáticas con modelos de 8B parámetros, superando a modelos de tamaño similar e incluso comparables más grandes.

Modelos de IA Interesantes (lanzamientos y tendencias)

Qwen-Image-2512 (Qwen).

Fuente: [clic aquí]

Iteración de diciembre del modelo text-to-image que reduce el aspecto “AI-like”, añade detalle fino en humanos, paisajes y texto, y mantiene soporte multilingüe con pipeline de diffusers listo para producción.

IQuest-Coder-V1-40B-Loop-Instruct (IQuestLab).

Fuente: [clic aquí]

Familia de LLMs para ingeniería de software con entrenamiento multi-etapa sobre flujo de commits, loop recurrente para abaratar despliegues, contexto nativo 128K y resultados líderes (SWE-Bench Verified 76.2%, LiveCodeBench v6 81.1%).

Grok 5 (xAI).

Fuente: [clic aquí]

La ronda Serie E financiará la siguiente generación del modelo multimodal de xAI, que busca cerrar la brecha frente a ChatGPT y Gemini con más cómputo propietario y data-centers ampliados.

HyperNova-60B (HyperNova AI).

Fuente: [clic aquí]

Modelo 59B activo con cuantización MXFP4 optimizada para despliegues de bajo consumo; ofrece 120 tokens/s en A100, soporte de contextos 64K y tooling de inferencia Triton listo para producción desde el 2 ENE 2026.

DiRL-8B-Instruct (DiRL).

Fuente: [clic aquí]

Primer dLLM post-entrenado con GRPO libre de sesgos, orientado a razonamiento matemático de alta dificultad con inferencia optimizada vía LMDeploy.

Utilidades para builders

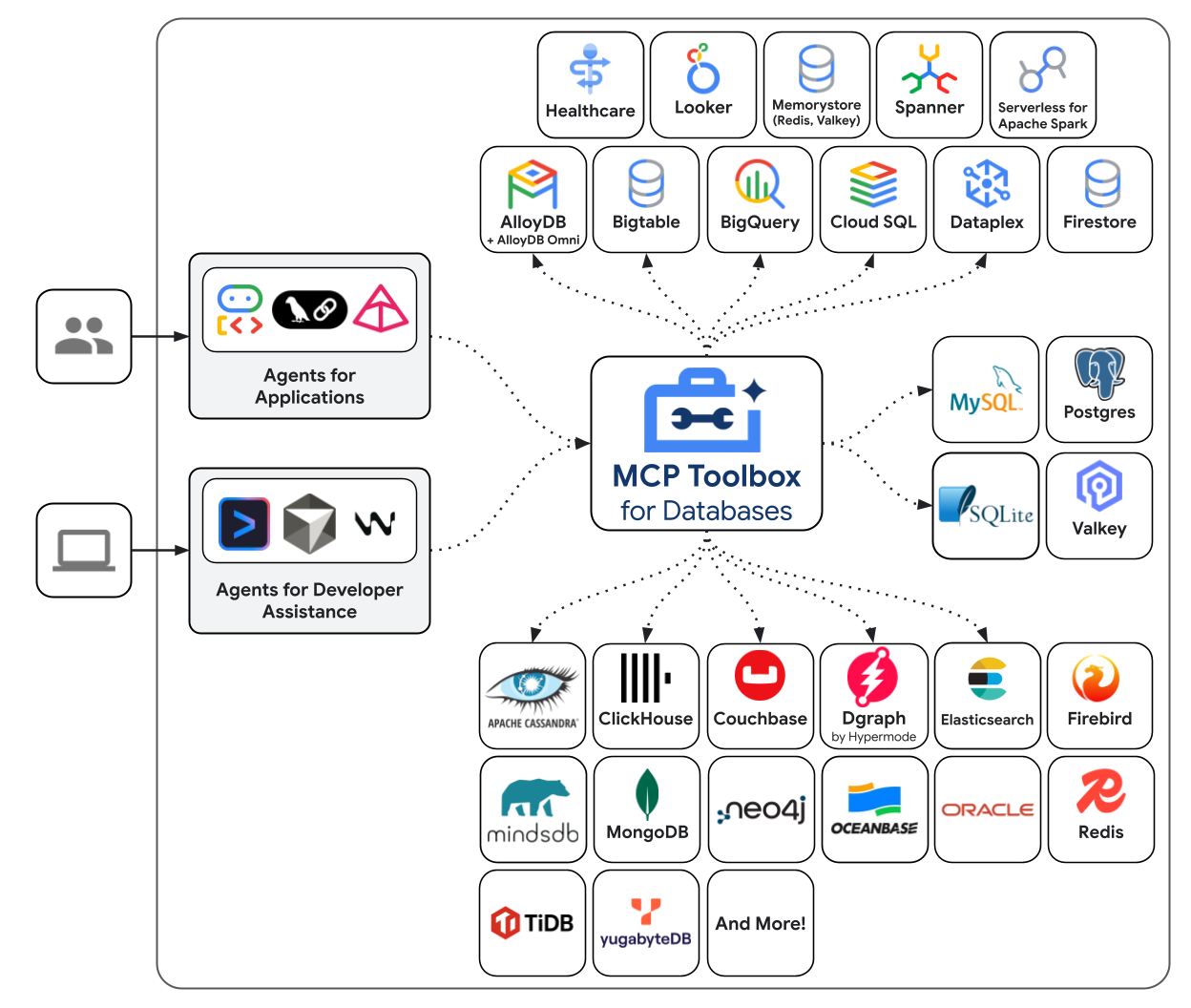

genai-toolbox (googleapis).

Fuente: [clic aquí]

Servidor MCP modular para orquestar herramientas conectadas a bases de datos con observabilidad, rate limiting y SDKs en Go, Python y JS.

full-stack-fastapi-nextjs-llm-template (vstorm-co).

Fuente: [clic aquí]

Generador de proyecto productivo que une FastAPI, Next.js y agentes LangChain/PydanticAI con streaming WebSocket y despliegues Docker.

datos-gob-es-mcp (AlbertoUAH).

Fuente: [clic aquí]

Servidor MCP para datos abiertos españoles que integra datos.gob.es, INE, AEMET y BOE con búsquedas semánticas, cache 24h y recursos temáticos listos para Claude/GPT.

Algunas Noticias Breves de IA

Marvell adquiere XConn por $540M (60% en efectivo, 40% en acciones) para reforzar switching de data centers de IA; espera sumar $100M en ingresos en FY2028 tras cerrar la compra a inicios de 2026.

Fuente: [clic aquí]

AWS y el proveedor alemán Aumovio amplían su alianza: AWS se convierte en cloud preferido para validar conductores autónomos con herramientas agentic, comenzando con los camiones de Aurora previstos para 2027.

Fuente: [clic aquí]

Italia cierra la investigación contra DeepSeek tras imponer compromisos para advertir sobre alucinaciones, reforzando las obligaciones de transparencia para modelos chinos en la UE.

Fuente: [clic aquí]

Coinbase estandariza agentes internos de alto código con LangGraph y LangSmith, logrando pasar de 12 semanas a menos de una para lanzar automatizaciones auditables y con observabilidad completa.

Fuente: [clic aquí]

Adobe habilita Photoshop, Express y Acrobat dentro de ChatGPT para que cualquier usuario edite imágenes, diseñe piezas y gestione PDFs directamente desde prompts conversacionales.

Fuente: [clic aquí]

OpenAI abre solicitudes para Grove, un programa de cinco semanas en San Francisco que ofrece mentoría, acceso anticipado a modelos y comunidad para unas quince personas en etapa cero de creación de startups.

Fuente: [clic aquí]