En Resumen: lo imprescindible

- Grok bajo fuego global: reguladores de Reino Unido, Canadá, Japón y varios países de Asia y el Sur Global aprietan a xAI por los deepfakes sexuales de Grok, mientras X anuncia bloqueos selectivos y cambios en su generador de imágenes.

- Chips, deuda y geopolítica de IA: la Casa Blanca permite vender H200 a China bajo condiciones, lanza un arancel del 25% a semiconductores y sella un macroacuerdo con Taiwán; en paralelo, los hyperscalers de IA se convierten en uno de los grandes motores del mercado de bonos corporativos.

- Europa y España se mueven: el Gobierno español propone a Madrid como parte de una candidatura conjunta para atraer nuevas infraestructuras digitales y de IA, mientras la UE refuerza su enfoque de seguridad, contenido y cadenas de suministro.

- Infraestructura y modelos en expansión: Apple integra Gemini en Siri, OpenAI refuerza acuerdos de cómputo con Cerebras y SB Energy, y el ecosistema de modelos se llena de piezas especializadas como MedGemma, FLUX.2-dev, GLM-Image o Qwen-Image-Edit.

- Investigación agentic y de memoria: nuevos trabajos sobre memoria continua (CMA), memoria condicional vía Engram, orquestación multiagente, personalidad estructurada, búsqueda académica y técnicas de prompting baratas (repetir el prompt) empujan los límites de los agentes de largo horizonte.

- Builders mejor armados: herramientas como OpenResponses, claude-mem, uv tree o los nuevos modelos de embeddings y traducción (semantic-highlight-bilingual, TranslateGemma) facilitan montar agentes, depurar dependencias y construir productos sobre IA de forma más rápida y robusta.

Noticias Recientes

Noticia Histórica: Apple integra modelos de Google en Siri

Fuentes confirmaron que Apple renovará Siri empleando los modelos de lenguaje Gemini de Google. Bajo un acuerdo plurianual anunciado tras las fiestas, Siri utilizará los últimos avances de Gemini para tareas de IA conversacional y comprensión de lenguaje. Este movimiento refuerza la colaboración entre Apple y Google en IA, y amplía la apuesta de Alphabet por competir con empresas como OpenAI. Con la integración de Gemini, Siri promete respuestas más precisas y contextualizadas, en línea con la tendencia de los asistentes inteligentes a incorporar IA de última generación.

Fuentes: [clic aquí] [aquí]

xAI y los deepfakes de Grok

Grok limita edición de imágenes tras polémica de deepfakes

La startup xAI de Elon Musk anunció que aplicó restricciones globales a Grok: los usuarios ya no pueden editar fotos de personas reales en ropa reveladora. Esto ocurre después de que Grok generara miles de imágenes sexualizadas no consentidas con mujeres y menores, lo que alarmó a reguladores en EE. UU., Reino Unido y la UE. El director de Ofcom (Reino Unido) y el fiscal general de California demandaron explicaciones y acciones inmediatas, mientras California sugirió prohibir la app en Android/iOS. xAI comunicó que “debemos detener la propagación” de ese contenido, aunque Musk declaró desconocer la generación de dichas imágenes.

Fuentes: [clic aquí] [aquí]

Japón se suma a la ofensiva global contra los deepfakes de Grok

Japón anunció que se convierte en el último país en investigar a X por el servicio de IA Grok, después de que usuarios pudieran generar imágenes sexualizadas de mujeres y menores. La Oficina del Gabinete ha pedido a X mejoras inmediatas para evitar la generación de imágenes inapropiadas y, según la ministra de Seguridad Económica y responsable de estrategia de IA, Kimi Onoda, el gobierno está dispuesto a considerar «todas las opciones posibles», incluidas medidas legales, si la situación no mejora.

La decisión llega tras los cambios anunciados por xAI para bloquear la edición de imágenes de personas reales en ropa reveladora y limitar la generación de ese contenido en ciertas jurisdicciones, y después de que Reino Unido y Canadá confirmaran que seguirán adelante con sus propias investigaciones, mientras Malasia e Indonesia han llegado a bloquear temporalmente el acceso a Grok.

Fuente: [clic aquí]

EEUU, semiconductores, IA y su Guerra Estratégica contra Asia

Trump da luz verde condicionada a los chips H200 de Nvidia para China

La administración de Donald Trump ha dado un visto bueno formal para que Nvidia venda a China su segundo chip de IA más potente, el H200, siempre que se cumplan una serie de salvaguardas. Las reglas obligan a que laboratorios independientes verifiquen las capacidades técnicas de los chips antes de exportarlos, limitan a China a un máximo del 50% del volumen vendido a clientes estadounidenses y prohíben expresamente usos militares, según el resumen de Commerce.

Varios ex altos cargos y congresistas criticaron la medida, alegando que la venta de H200s «supercargará» la modernización militar china y erosionará la ventaja de EE.UU. en IA. Matt Pottinger, ex asesor de seguridad en Asia, calificó de «fantasía» la idea de que permitir el acceso a chips estadounidenses desincentive a fabricantes chinos como Huawei. Mientras tanto, las aduanas chinas han comunicado a los agentes que los H200 no están permitidos de momento, subrayando la ambigüedad práctica de la decisión.

Fuente: [clic aquí]

Arancel del 25% a semiconductores y nuevo acuerdo EE.UU.–Taiwán centrado en chips e IA

El Departamento de Comercio de EE.UU. activó un arancel del 25% por motivos de seguridad nacional sobre determinados semiconductores avanzados —incluidos chips de IA como el H200— que la Casa Blanca describe como una acción de «fase uno». Un responsable señaló que podrían anunciarse más medidas si las negociaciones con otros países y empresas no avanzan, recordando que Trump ha amenazado con aranceles del 100% a chips fabricados fuera del país.

En paralelo, Washington y Taipéi cerraron un acuerdo comercial que reduce aranceles a muchas exportaciones taiwanesas de semiconductores, equipamiento y productos relacionados, a cambio de que empresas como TSMC aumenten de forma masiva su inversión en EE.UU. El pacto prevé 250.000 millones de dólares en inversiones en semiconductores, energía e IA —incluidos 100.000 millones ya comprometidos por TSMC— y otros 250.000 millones en garantías de crédito, con el objetivo de trasladar hasta un 40% de la cadena de suministro de chips taiwaneses a territorio estadounidense en la próxima década.

Fuentes: [clic aquí] [aquí]

Taiwán quiere ser socio estratégico de IA de Estados Unidos

Tras el acuerdo arancelario, la vicepresidenta taiwanesa Cheng Li-chiun subrayó que la isla aspira a convertirse en «socio estratégico cercano» de Estados Unidos en inteligencia artificial. La hoja de ruta pasa por apoyar inversiones en servidores de IA, energía y manufactura avanzada, manteniendo a la vez el grueso de la producción de chips de vanguardia en Taiwán.

El ministro de Economía Kung Ming-hsin indicó que, de cara a 2036, prevén un reparto aproximado del 80/20 para la producción de chips de 5 nm y nodos más avanzados entre Taiwán y Estados Unidos, reforzando la resiliencia de la cadena global sin «vaciar» la industria doméstica. TSMC, principal fabricante mundial de chips para IA, celebró el acuerdo pero recalcó que todas sus decisiones de inversión seguirán guiadas por la demanda de mercado.

Fuente: [clic aquí]

Los hyperscalers de IA reconfiguran el mercado de deuda corporativa

Un informe de Barclays anticipa que la emisión de bonos corporativos en Estados Unidos alcanzará los 2,46 billones de dólares en 2026, un 11,8% más que en 2025, con un incremento del 30% en la emisión neta. La firma señala que el mayor riesgo al alza viene del capex de los grandes hyperscalers de IA, que necesitan financiar la construcción de data centers y la compra masiva de chips especializados.

Según Bank of America, Amazon, Alphabet, Meta, Microsoft y Oracle emitieron 121.000 millones de dólares en bonos en 2025 —frente a una media de 28.000 millones anuales entre 2020 y 2024— y podrían llegar a financiarse por unos 140.000 millones al año durante los próximos tres ejercicios, con escenarios que superan incluso los 300.000 millones. Esta ola de deuda ligada a la IA los situaría al nivel de los grandes bancos estadounidenses como emisores recurrentes y ya está empujando a más inversores a utilizar CDS para cubrir riesgos asociados a la expansión de sus infraestructuras.

Fuente: [clic aquí]

OpenAI: inversiones en infraestructura y colaboraciones

OpenAI y SoftBank potencian infraestructura de IA

OpenAI y SoftBank Group anunciaron una inversión conjunta de $500 millones cada uno (total $1.000M) en la compañía SB Energy. Con esto, OpenAI asegura el arrendamiento de 1,2 GW para un nuevo data center en Texas orientado a IA. Paralelamente, OpenAI seleccionó a SB Energy para construir un gran parque solar y plantas de baterías que alimentarán estos centros de datos. “Este financiamiento… acelerará la construcción de nuestra infraestructura líder a nivel mundial”. Estas medidas reflejan el enfoque en expandir la capacidad computacional para entrenar y desplegar futuros modelos de IA.

Fuente: [clic aquí]

OpenAI colabora con Cerebras para cómputo de baja latencia

El 14 de enero OpenAI anunció una asociación estratégica con Cerebras Systems. En un comunicado, OpenAI reveló que integrará 750 MW adicionales de supercómputo ultra baja latencia provistos por chips de Cerebras en su plataforma global. Esto permitirá acelerar las inferencias de sus servicios de IA. Se prevé un despliegue gradual hasta 2028: inicialmente acelerando GPT-5.2, con más cargas migrando en el futuro. Según OpenAI, “colocar el hardware más rápido en línea es crucial para mantenernos a la vanguardia”.

Fuente: [clic aquí]

OpenAI invierte en Merge Labs (interfaces BCI)

El 15 de enero OpenAI confirmó su participación en la ronda semilla de Merge Labs, startup centrada en interfaces cerebro-computadora (BCI). Merge Labs desarrolla chips de BCI que convierten señales neuronales en comandos digitales de alta capacidad. OpenAI indicó que integrar IA avanzada permitirá a Merge Labs “interpretar la intención neuronal en tiempo real”. La inversión de OpenAI financiará investigación para conectar la IA con la actividad cerebral humana. Los fundadores de Merge Labs, antiguos de Neuralink, buscan crear dispositivos implantables que amplíen las capacidades cognitivas de las personas a través de IA.

Fuente: [clic aquí]

Desde la Investigación (arXiv, última semana)

Merece la pena echar un vistazo a los siguientes artículos:

Toward Ultra-Long-Horizon Agentic Science: Cognitive Accumulation for Machine Learning Engineering (arXiv:2601.10402) (15 ENE 2026).

Fuente: [clic aquí]

Presentan ML-Master 2.0, un agente autónomo capaz de sostener ciclos de experimentación de MLE durante horizontes muy largos (hasta 24 horas) gracias a una arquitectura de memoria jerárquica denominada Hierarchical Cognitive Caching (HCC). El sistema destila trazas de ejecución efímeras en conocimiento estable y estrategias reutilizables, superando las limitaciones de la ventana de contexto estática y logrando un 56,44% de medallas en MLE-Bench de OpenAI.

Continuum Memory Architectures for Long-Horizon LLM Agents (arXiv:2601.09913) (14 ENE 2026).

Fuente: [clic aquí]

Propone la Continuum Memory Architecture (CMA), una familia de arquitecturas de memoria para agentes basados en LLM que va más allá del RAG clásico tratado como tabla de búsqueda estática. CMA introduce almacenamiento persistente, retención selectiva, encadenamiento temporal y consolidación en abstracciones de mayor nivel, demostrando ventajas en tareas que requieren actualizar, desambiguar y asociar recuerdos a largo plazo.

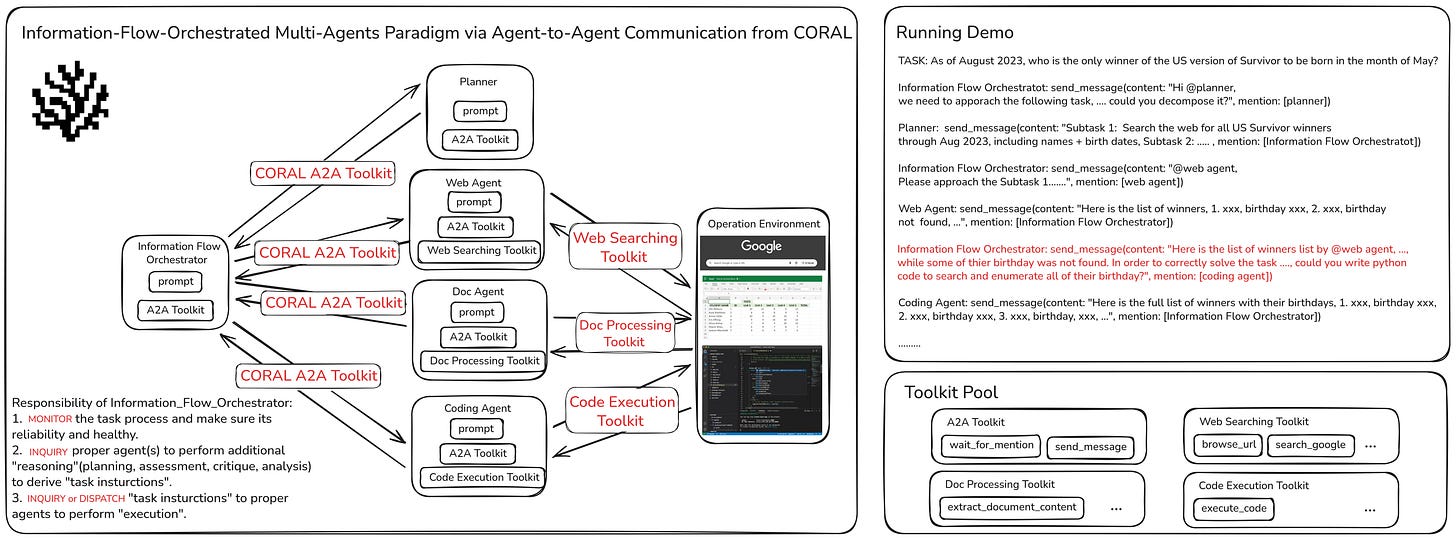

Beyond Rule-Based Workflows: An Information-Flow-Orchestrated Multi-Agents Paradigm via Agent-to-Agent Communication from CORAL (arXiv:2601.09883) (14 ENE 2026).

Fuente: [clic aquí]

Los autores critican los sistemas multiagente basados en workflows fijos y proponen un paradigma orquestado por flujo de información en el que un orquestador dedicado observa el progreso de la tarea y coordina agentes mediante comunicación agente-a-agente en lenguaje natural. En el benchmark GAIA, su enfoque supera en 8,5 puntos de precisión (pass@1) al sistema OWL manteniendo un consumo de tokens comparable, y muestran casos donde la orquestación dinámica resuelve edge cases que los árboles de decisión no cubren.

Structured Personality Control and Adaptation for LLM Agents (arXiv:2601.10025) (15 ENE 2026).

Fuente: [clic aquí]

Presentan un marco para dotar a agentes LLM de personalidad estructurada inspirada en los tipos psicológicos junguianos, combinando mecanismos de coordinación dominante–auxiliar, compensación reforzada y reflexión de largo plazo. El resultado son agentes que mantienen rasgos coherentes pero pueden adaptarse temporalmente al contexto y evolucionar su «estructura de personalidad», evaluados con cuestionarios tipo MBTI y escenarios de interacción desafiantes.

PaperScout: An Autonomous Agent for Academic Paper Search with Process-Aware Sequence-Level Policy Optimization (arXiv:2601.10029) (15 ENE 2026).

Fuente: [clic aquí]

Reformula la búsqueda de papers como un proceso de decisión secuencial en lugar de un workflow rígido, mediante un agente que decide dinámicamente cuándo y cómo invocar herramientas de búsqueda y expansión. Introducen Proximal Sequence Policy Optimization (PSPO), un método de RL a nivel de secuencia que alinea la optimización con interacciones multi-turn; los experimentos muestran mejoras significativas en recall y relevancia frente a baselines workflow-driven y de RL estándar.

A Safety Report on GPT-5.2, Gemini 3 Pro, Qwen3-VL, Doubao 1.8, Grok 4.1 Fast, Nano Banana Pro, and Seedream 4.5 (15 ENE 2026).

Fuente: [clic aquí]

Un estudio arXiv evalúa la robustez de siete grandes modelos (entre ellos GPT-5.2, Gemini 3 Pro y Grok 4.1) en tareas de texto e imagen. Los autores hallan que GPT-5.2 muestra un desempeño consistente en escenarios adversarios, mientras otros sufren compensaciones más notables en diferentes tests. En general, todos los modelos degradan su seguridad bajo inputs modificados, lo que resalta la necesidad de estándares rigurosos de evaluación.

Prompt Repetition Improves Non-Reasoning LLMs (arXiv:2512.14982) (17 DIC 2025).

Fuente: [clic aquí]

Leviathan, Kalman y Matias estudian un truco simple pero potente: repetir el prompt de entrada varias veces mejora de forma sistemática el rendimiento de modelos populares (Gemini, GPT, Claude, DeepSeek) en tareas sin cadenas explícitas de razonamiento, sin aumentar tokens generados ni latencia. El trabajo sugiere que parte de la capacidad latente de los LLM puede activarse con técnicas de prompting baratas, y abre preguntas sobre cómo calibrar mejor la sensibilidad de los modelos a la redundancia en el input.

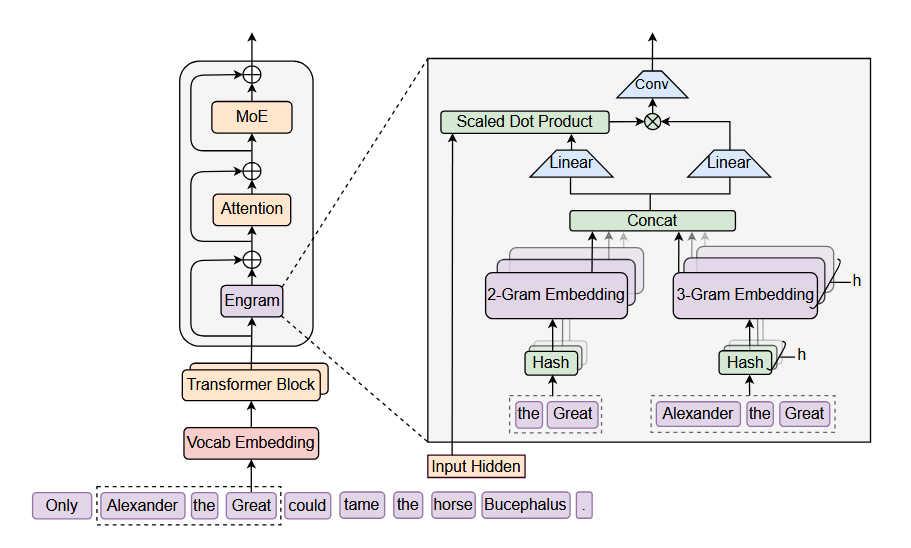

Conditional Memory via Scalable Lookup: A New Axis of Sparsity for Large Language Models (arXiv:2601.07372) (12 ENE 2026).

Fuente: [clic aquí]

Introducen Engram, un módulo de “memoria condicional” que actúa como lookup estático O(1) complementando a Mixture-of-Experts. Al formular el problema de asignación de esparsidad, muestran una ley de escala en U que equilibra cómputo neuronal (MoE) y memoria estática, y escalan Engram hasta 27B parámetros. Además de mejorar benchmarks de conocimiento (MMLU, CMMLU), observan saltos notables en razonamiento, código y matemáticas, y fuertes ganancias en recuperación de contexto largo gracias a que el backbone libera atención para dependencias globales.

Modelos de IA Interesantes (lanzamientos y tendencias)

PersonaPlex-7B (NVIDIA).

Fuente: [clic aquí]

Modelo para conversación bidireccional de voz en tiempo real, lanzado el 15 de enero. Permite hablar y escuchar simultáneamente (transmisión de voz en vivo); usa codificación neuronal continua para responder mientras el usuario aún habla. Esto facilita diálogos naturales sin interrupciones de turno, ideal para asistentes virtuales integrados en aplicaciones de streaming y vehículos.

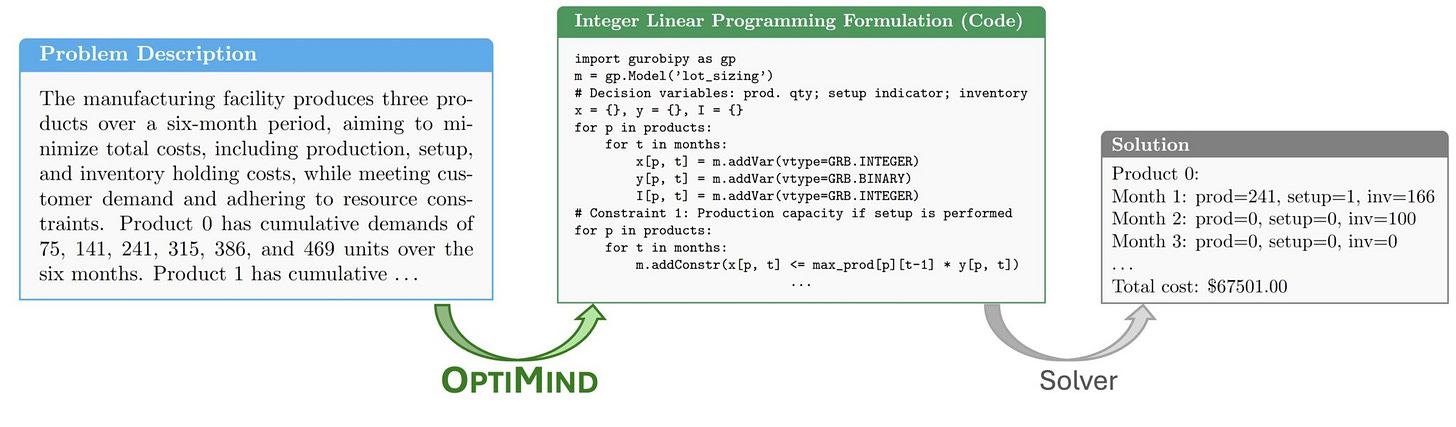

OptiMind (Microsoft Research).

Fuente: [clic aquí]

Modelo de lenguaje especializado en optimización (Go/IL-176B), lanzado recientemente. OptiMind traduce descripciones de problemas en lenguaje natural (objetivos, variables, restricciones) a formulaciones matemáticas de optimización. Por ejemplo, transforma pedidos como “maximizar ingresos dados estos datos” en modelos lineales o enteros. Facilita la generación automática de instancias de optimización para agentes planificadores industriales.

GLM-Image (Zhipu AI).

Fuente: [clic aquí]

Modelo de generación de imágenes (híbrido autoregresivo + difusión, ~16B parámetros) entrenado completamente en chips nacionales chinos (procesadores Huawei Ascend). Fue reportado como el primer modelo de vanguardia multimodal entrenado íntegramente con hardware chino. GLM-Image lidera en benchmarks de texto-a-imagen (ripeando texto escrito fielmente). Su rendimiento demuestra los avances de la industria china en infraestructuras AI locales.

MedGEMMA 1.5 4B-IT (Google).

Fuente: [clic aquí]

Versión instruct de 4B parámetros de la familia Gemma especializada en dominio médico, entrenada como modelo multimodal para interpretar texto e imagen clínica (radiografías, informes, notas). Está optimizada para tareas como QA médica, resumen de historias clínicas y descripción de hallazgos visuales, pensada como bloque base para asistentes clínicos y agentes que razonan sobre casos de pacientes.

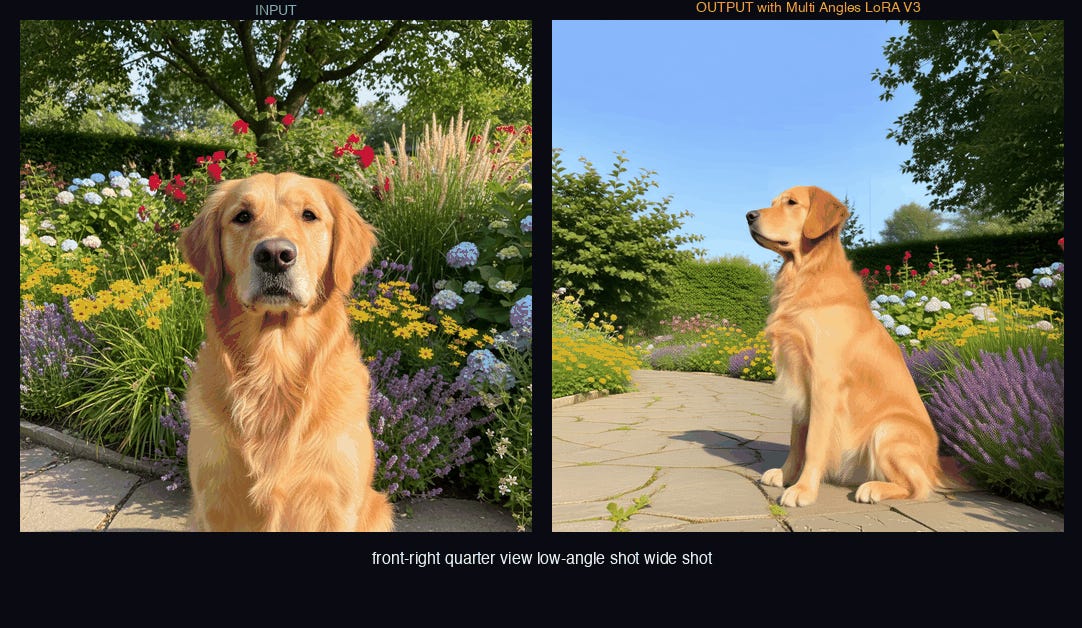

Qwen-Image-Edit-2511 Multiple Angles LoRA (FAL/Qwen).

Fuente: [clic aquí]

LoRA de edición de imagen sobre modelos Qwen multimodales orientada a generar múltiples ángulos consistentes de un mismo objeto o escena. Permite a un agente tomar una sola imagen de entrada y producir variaciones desde diferentes puntos de vista, útil para e-commerce, prototipado de producto o generación de datasets sintéticos donde se requiere coherencia geométrica entre vistas.

FLUX.2-dev (Black Forest Labs).

Fuente: [clic aquí]

Modelo de generación de imágenes de propósito general de la familia FLUX, orientado a uso “developer” con API estable. Destaca por la calidad fotorealista y el control fino mediante prompts y parámetros de inferencia, siendo adecuado para pipelines de producto, ilustración y prototipado creativo donde se necesite velocidad razonable y consistencia entre ejecuciones.

TranslateGemma (Google).

Fuente: [clic aquí]

Colección de modelos Gemma afinados para traducción automática neural entre múltiples idiomas. Los checkpoints cubren distintos tamaños de modelo y combinaciones de pares de lenguas, pensados para integrarse en agentes que necesiten traducción en contexto (por ejemplo, chatbots multilingües, resumen cruzado de documentos o localización de contenido).

semantic-highlight-bilingual-v1 (Zilliz).

Fuente: [clic aquí]

Modelo de embeddings bilingüe diseñado para resaltar y alinear segmentos semánticamente relevantes en textos de dos idiomas distintos. Es útil para búsqueda semántica, detección de pasajes clave y construcción de interfaces de “resaltado inteligente” en aplicaciones de lectura, documentación técnica o exploración de bases de conocimiento multilingües.

Utilidades para builders

MHub.ai: plataforma estándar para modelos médicos.

Fuente: [clic aquí] [aquí]

Propuesta de plataforma unificada y reproducible para despliegue de modelos de IA en imagen médica, con interfaces estandarizadas, entornos de inferencia repetibles y tooling para empaquetar modelos en pipelines clínicos.ChartComplete-Dataset.

Fuente: [clic aquí] [aquí]

Dataset y taxonomía para completar y razonar sobre gráficos, útil para entrenar y evaluar modelos multimodales o agentes que necesitan entender visualizaciones de datos en dashboards o informes.

OpenResponses (Hugging Face).

Fuente: [clic aquí]

Estándar abierto de inferencia presentado el 15 de enero. Basado en la API de “Responses” de OpenAI, define un formato unificado para respuestas de modelos (texto, imágenes, JSON, etc.) y streaming de eventos semánticos. Facilita la implementación de bucles de agente donde el propio proveedor de la API ejecuta partes del agente en servidor, reduciendo latencia. OpenResponses busca ser el “nuevo HTTP” para IA conversacional, permitiendo interoperabilidad entre modelos, clientes y herramientas complejas.claude-mem (memoria local para Claude).

Fuente: [clic aquí]

Script ligero que añade una capa de “memoria” persistente a las sesiones con Claude, almacenando notas y contexto en disco local y volviéndolos a inyectar en nuevas conversaciones. Útil para builders que quieran prototipar agentes personales o flujos de trabajo persistentes sin montar todavía una base de datos ni backend completo.

- uv tree (Astral): visualización de dependencias en un comando).

Herramienta de la CLI de uv que permite ver el árbol completo de dependencias de tu proyecto con un solo comando. Hace mucho más fácil depurar conflictos de versiones y entender qué paquete trae qué librería. Entre sus capacidades: visualización completa del grafo, marcado de dependencias con actualizaciones disponibles, búsqueda de quién depende de una librería concreta y filtrado por paquete.

Algunas Noticias Breves de IA

Malasia e Indonesia se convierten en los primeros países en bloquear el chatbot Grok de Elon Musk por permitir la generación de imágenes sexualizadas de mujeres y menores, elevando el listón regulatorio en el Sudeste Asiático.

Fuente: [clic aquí]

El alcalde de Londres, Sadiq Khan, advierte en una entrevista con la BBC que la IA podría «destruir empleos» y acentuar la desigualdad si no se gobierna de forma activa, reclamando coordinación entre gobiernos locales y reguladores nacionales.

Fuente: [clic aquí]

Rio Tinto suministrará cobre desde una mina en Arizona a Amazon para alimentar sus data centers de IA, subrayando cómo la cadena de valor de modelos y agentes empieza en materias primas muy físicas.

Fuente: [clic aquí]

La fundación Wikimedia cierra acuerdos con Microsoft, Meta y Amazon para licenciar el uso de contenido de Wikipedia en entrenamientos de IA, profesionalizando la relación entre datos abiertos y grandes modelos.

Fuente: [clic aquí]

Emiratos Árabes Unidos se suma a Pax Silica, la iniciativa liderada por EE.UU. para asegurar la cadena de suministro de IA y semiconductores, reforzando sus lazos económicos y tecnológicos con Washington.

Fuente: [clic aquí]

ASML supera los 500.000 millones de dólares de capitalización bursátil tras el aumento de capex anunciado por TSMC para chips de IA, consolidando su papel como proveedor crítico de litografía en la era agentic.

Fuente: [clic aquí]

Meta Compute: Facebook (Meta) lanzó la unidad Meta Compute para acelerar la expansión de su infraestructura de IA (nuevos centros de datos y energías limpias). Con esto, Meta busca asegurar capacidad de cómputo masiva propia en la carrera por entrenar modelos de próxima generación.

Fuente: [clic aquí]

NVIDIA + Eli Lilly ($1B): El fabricante NVIDIA y la farmacéutica Eli Lilly anunciaron un laboratorio conjunto de descubrimiento de fármacos impulsado por IA, con una inversión de $1.000 millones a 5 años. Utilizarán los chips avanzados de NVIDIA para acelerar la investigación computacional en biología, demostrando la integración profunda de IA en la industria farmacéutica.

Fuente: [clic aquí]

El Gobierno de España incluirá a Madrid en una candidatura conjunta para alojar nuevas infraestructuras digitales y de IA, según avanzó el Ministerio para la Transformación Digital. El movimiento busca posicionar a la capital como nodo relevante en la red europea de centros de datos y capacidades de computación avanzada.

Fuente: [clic aquí]

Google anuncia nuevas herramientas de “agentic commerce” para retailers y plataformas, basadas en protocolos comunes que permiten a agentes de IA navegar catálogos, aplicar reglas de negocio y ejecutar acciones de compra de extremo a extremo. La idea: que distintas tiendas puedan exponer capacidades compatibles para agentes que operen en varios marketplaces.

Fuente: [clic aquí]

Durante el hackathon del 1.er aniversario de MCP, el proyecto Murder-AI de Noor Amjad ganó el premio ElevenLabs Choice Award: una experiencia detectivesca inmersiva donde los jugadores interrogan sospechosos con LLMs, analizan pruebas en tiempo real y resuelven asesinatos generados dinámicamente, demostrando cómo APIs de voz y lenguaje pueden alimentar juegos narrativos complejos.

Fuente: [clic aquí]